大模型干货:全面剖析 MCP、A2A 与 Function Calling 的架构关系

让模型先“动手”;MCP让所有手都能用同一“插口”;A2A让多双手排成流水线、真正高效协作。在工程实践里,可以把三条协议视作渐进式层叠带来最小可行能力;MCP消除接口碎片、释放生态价值;A2A则让能力真正“组织化”,完成复杂任务。当下没有哪条路线独占未来,但把系统设计成可插拔、可组合,才能在技术快速迭代中保持韧性。如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我

0. 导读

阅读重点

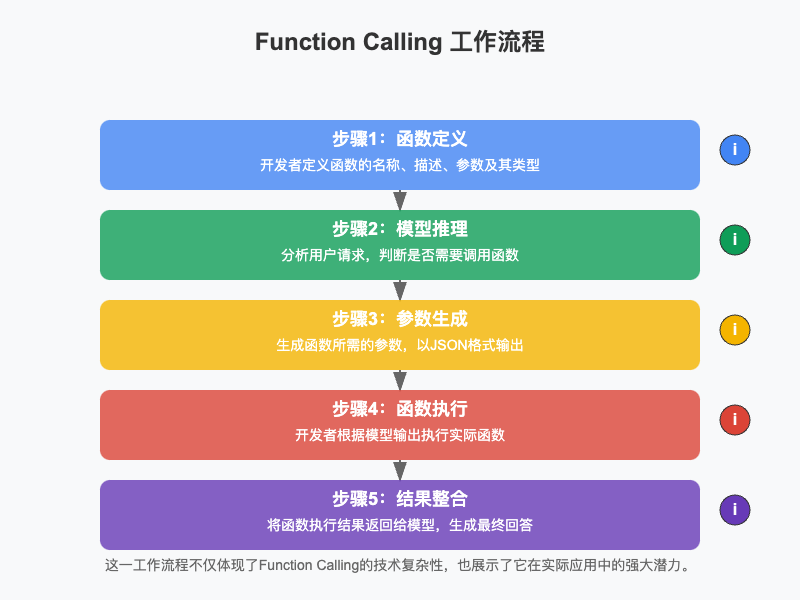

- Function Calling:模型如何“伸手”操作工具

- MCP:工具如何“统一接头”对接模型

- A2A:多智能体如何“互相喊话”分工协作

- 三者不是替代,而是“工具调用 → 接口标准化 → 智能体协作”的递进演化

1. 演进脉络概览

-

2023 Q3 OpenAI — Function Calling

让 GPT‑4 能在一次对话里发起 API 调用。

-

2024 Q4 Anthropic — MCP

用统一协议把“任意工具 × 任意模型”拆解为线性成本。

-

2025 Q2 Google — A2A

让多个 Agent 形成流水线,共同完成长链路任务。

- Function Calling:最短路径把 LLM 与单一函数相连

| 关键环节 | 工程要点 |

|---|---|

| 识别意图 | LLM 基于自然语言判断是否需要外部数据 |

| 挑选函数 | 依赖 prompt 中给出的 JSON Schema |

| 组装参数 | 纯 JSON,幂等性由业务自行保证 |

| 返回结果 | LLM 将 JSON 响应“翻译”成自然语言 |

适用场景

- 单模型、少量工具、快速 MVP

- 服务调用以 GET/POST 为主、链路 < 1 步

局限

-

N×M 适配

:换模型、加工具都要重写 schema

-

无法原生链式

:多步调用需应用显式编排

-

接口碎片化

:各家厂商语法不一

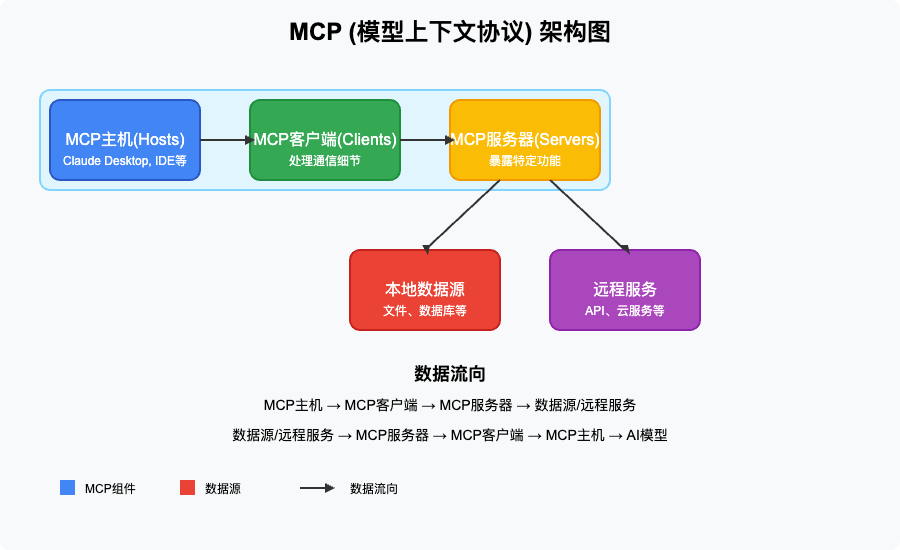

3. MCP:把“模型 × 工具”降维为“模型 + 工具”

| 组件 | 角色 | 典型实现 | 关注点 |

|---|---|---|---|

| Host | 用户端入口 | Claude Desktop, IDE 插件 | 体验聚合 |

| Client | 长连接管理 | 官方/三方 SDK | 连接复用、流控 |

| Server | 工具包装器 | 向量检索服务、数据库桥 | 统一 RPC & 权控 |

| 数据源 | 真正的 API / 文件 | 本地或云服务 | 安全隔离 |

核心优势

-

一次对接,多端复用

:Server 写一次,任何 Client 可用

-

本地优先

:敏感数据留在端侧,满足合规

-

天然多步

:Server 可内部再调用其他 Server,形成链式调用

-

生态累积

:社区已有大量开源 Server,可即插即用

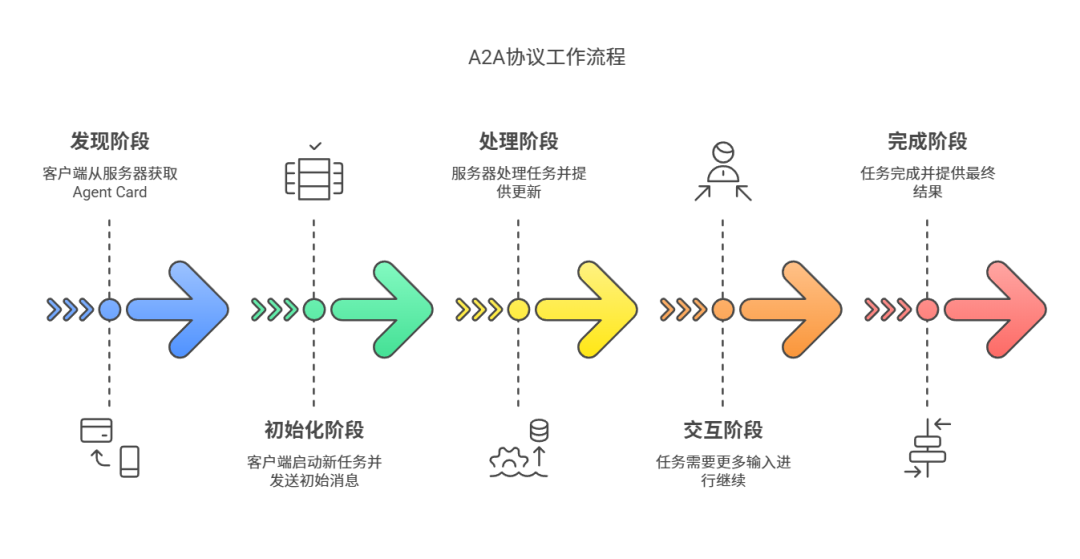

4. A2A:让多 Agent 成为“协同作战小队”

4.1 关键术语

-

A2A Client

:任务发起者

-

A2A Server

:任务调度与状态广播

-

Task State

:

SUBMITTED → IN_PROGRESS → WAITING_INPUT? → SUCCEEDED/FAILED

4.2 生命周期

-

提交任务

:HTTP POST 包含任务类型与负载

-

即时回执

:返回

task_id与SUBMITTED状态 -

流式更新

:SSE/gRPC‑stream 推送进度

-

终态输出

:回调或轮询获取结果 / 错误栈

4.3 工程价值

-

横向扩展

:新增 Agent=新增节点,无需改中心调度

-

长链路透明

:状态机+心跳,易做 SLA 监控

-

能力协作

:搜索 Agent、翻译 Agent、总结 Agent 可流水线式串接

5. 三者对比与协同

| 维度 | Function Calling | MCP | A2A |

|---|---|---|---|

| 聚焦点 | 模型 ↔单工具 | 模型 ↔多工具 | Agent ↔ Agent |

| 通信模式 | 单次 RPC | 双工 JSON‑RPC / WebSocket | HTTP + SSE / gRPC‑stream |

| 扩展成本 | M×N | M+N | K(Agent 数) |

| 链式调用 | 应用层显式编排 | Server 内部可递归 | 原生 Task DAG |

| 典型角色 | “伸手” | “接头” | “喊话” |

关系总结

Function Calling ↔ MCP

:先有能“用”工具(Function Calling),再统一“接”工具(MCP)。

MCP ↔ A2A

:MCP 解决怎么做,A2A 解决谁来做。

A2A ↔ Function Calling

:单个 Agent 内仍可用 Function Calling 接本地函数。

速查表

典型决策情景

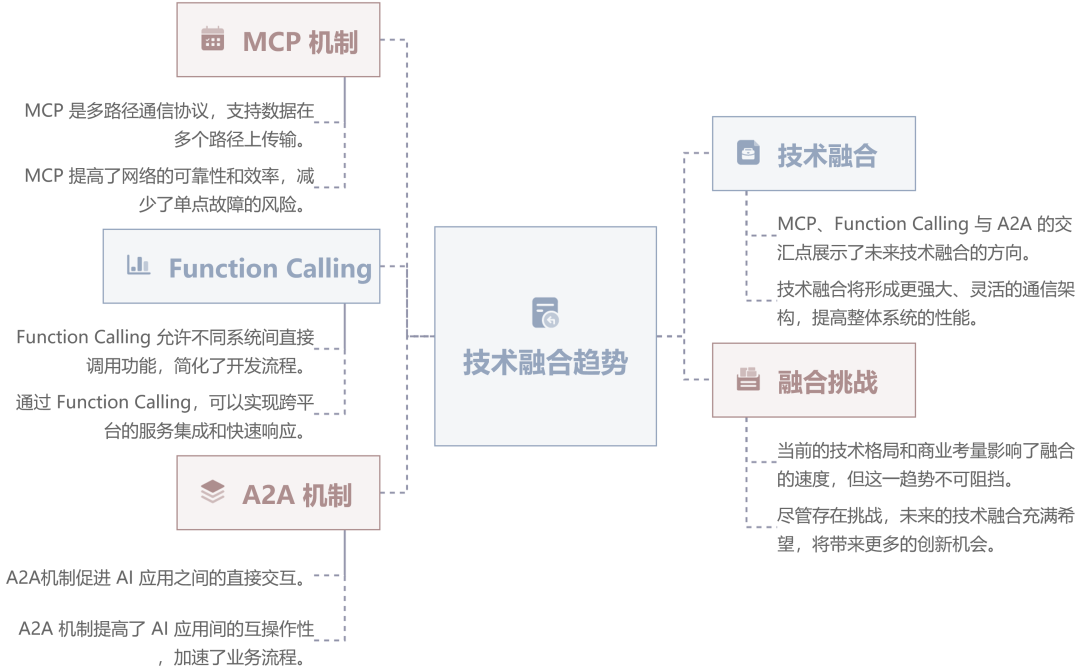

技术融合

长期来看,我们可能会看到这三大通信机制(Function Calling、MCP、A2A)逐渐融合的趋势。不过,目前 OpenAI 和 Anthropic 尚未支持 A2A。

6. 结语

三条协议并非此消彼长,而是逐层补位:

- Function Calling 让模型先“动手”;

- MCP 让所有手都能用同一“插口”;

- A2A 让多双手排成流水线、真正高效协作。

在工程实践里,可以把三条协议视作渐进式层叠:

Function Calling带来最小可行能力;MCP消除接口碎片、释放生态价值;A2A则让能力真正“组织化”,完成复杂任务。

当下没有哪条路线独占未来,但把系统设计成可插拔、可组合,才能在技术快速迭代中保持韧性。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

大模型全套学习资料领取

这里我整理了一份AI大模型入门到进阶全套学习包,包含学习路线+实战案例+视频+书籍PDF+面试题+DeepSeek部署包和技巧,需要的小伙伴文在下方免费领取哦,真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

部分资料展示

一、 AI大模型学习路线图

整个学习分为7个阶段

二、AI大模型实战案例

涵盖AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,皆可用。

三、视频和书籍PDF合集

从入门到进阶这里都有,跟着老师学习事半功倍。

四、LLM面试题

五、AI产品经理面试题

六、deepseek部署包+技巧大全

😝朋友们如果有需要的话,可以V扫描下方二维码联系领取~

更多推荐

已为社区贡献153条内容

已为社区贡献153条内容

所有评论(0)