Stable Diffusion【二次元模型】:最强扁平化风格大模型一键生成插画风格

二次元世界,以其独特的魅力,吸引了无数艺术爱好者和动漫迷。如今,借助StableDiffusion的二次元模型,你只需一键操作,就能轻松实现扁平化风格的插画创作。本文将带你深入了解StableDiffusion二次元模型的使用方法,助你轻松掌握这一技巧。StableDiffusion是一款基于深度学习的图像生成模型,它能够在没有任何人类指导的情况下生成高质量、逼真的图像。与传统的图像生成技术相比,

二次元世界,以其独特的魅力,吸引了无数艺术爱好者和动漫迷。如今,借助Stable

Diffusion的二次元模型,你只需一键操作,就能轻松实现扁平化风格的插画创作。本文将带你深入了解Stable

Diffusion二次元模型的使用方法,助你轻松掌握这一技巧。

Stable

Diffusion是一款基于深度学习的图像生成模型,它能够在没有任何人类指导的情况下生成高质量、逼真的图像。与传统的图像生成技术相比,Stable

Diffusion具有更高的生成质量和更快的生成速度。

今天和大家分享一款基于SD1.5的扁平化风格的二次元大模型:纯平简彩flatanime-

mix。对于喜欢扁平风格的小伙伴们,该模型还是非常值得推荐的。

目前最新的版本是V1.0版本,该版本对提示词的识别非常友好好,人物/场景/物体都能够表现。更多时候,该模型可以作为扁平化插画风格的二次元底膜使用。

模型下载地址 (文末可自行扫描获取)

作者在官网给出了该大模型推荐参数设置。

-

无需外挂VAE,或者用animevae,(vae-ft-mse-840000-ema-pruned.safetensors可能有一点模糊)

-

采样:Euler a

-

CFG:7-8

-

高清修复:R-ESRGAN 4X+Anime6,重绘幅度0.3左右

下面我们来实际体验一下,看使用这个模型出来的图片效果如何吧。

反向提示词

(worst quality:2),(low quality:2),(normal quality:2),lowres,bad anatomy,bad

hands,text,error,missing fingers,extra digit,fewer digits,cropped,jpeg

artifacts,signature,watermark,username,blurry

公共参数设置

-

大模型:纯平简彩 flatanime-mix V1.0

-

采样器:Euler a

-

采样迭代步数:20

-

CFG:7

-

图片宽高:512*768

1. 微笑

Prompt:(masterpiece, best quality:1.3),1girl,smile,red dress,upper

body,flowers,city background,

提示词 :(杰作,最佳质量:1.3),1女孩,微笑,红衣服,上身,花朵,城市背景,

2. 办公女士

Prompt :(masterpiece, best quality:1.3),1girl,solo,long hair,office

lady,sitting,full body,laptop,working,flowers,

提示词 :(杰作,最佳质量:1.3),1个女孩,独唱,长发,办公室女士,坐着,全身,笔记本电脑,工作,鲜花

3. 圣诞节

Prompt :(masterpiece, best quality:1.3),1 girl holds Christmas gifts in

her hands,wears a Christmas hat,Christmas tree,night lighting

提示词 :(杰作,最佳品质:1.3),1个女孩手里拿着圣诞礼物,戴着圣诞帽,圣诞树,夜灯

4. 绿发女孩

Prompt: (masterpiece, best quality:1.3),1 girl,green hair,curly

hair,green eyes,upper body,white background

提示词:(杰作,最佳质量:1.3),1个女孩,绿色头发,卷发,绿色眼睛,上半身,白色背景

5. 篮球运动员

Prompt: (masterpiece, best quality:1.3),1 boy,playing

basketball,sportswear

提示词:(杰作,最佳质量:1.3),1名男生,打篮球,运动服

6. 日落风景

Prompt: (masterpiece, best quality:1.3),no

humans,scenery,road,moutain,sunset

提示词:(杰作,最佳画质:1.3)、无人、风景、路、山、日落

7. 中国传统建筑

Prompt: (masterpiece, best quality:1.3),no humans,lanterns,traditional

Chinese architecture,mountains

提示词:(杰作,最好的质量:1.3),没有人,灯笼,中国传统建筑,山脉,

8. 花样年华

Prompt: (masterpiece, best quality:1.3),1 girl,red dress,upper

body,flowers, lora:花样年华:0.7

提示词:(杰作,最佳质量:1.3),1个女孩,红色连衣裙,上身,花朵,

好了,今天的分享就到这里了,希望今天分享的内容对大家有所帮助。

资料软件免费放送

次日同一发放请耐心等待

目前 ControlNet 已经更新到 1.1 版本,相较于 1.0 版本,ControlNet1.1 新增了更多的预处理器和模型,每种模型对应不同的采集方式,再对应不同的应用场景,每种应用场景又有不同的变现空间

我花了一周时间彻底把ControlNet1.1的14种模型研究了一遍,跑了一次全流程,终于将它完整下载好整理成网盘资源。

其总共11 个生产就绪模型、2 个实验模型和 1 个未完成模型,现在就分享给大家,点击下方卡片免费领取。

[外链图片转存中…(img-kPjJFmZd-1733740170811)]

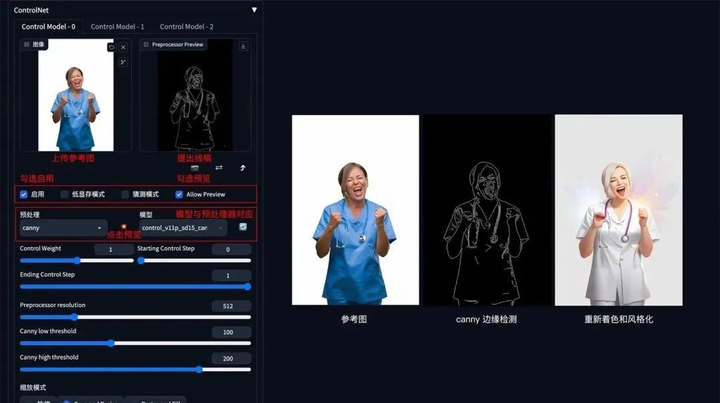

1. 线稿上色

**方法:**通过 ControlNet 边缘检测模型或线稿模型提取线稿(可提取参考图片线稿,或者手绘线稿),再根据提示词和风格模型对图像进行着色和风格化。

**应用模型:**Canny、SoftEdge、Lineart。

Canny 示例:(保留结构,再进行着色和风格化)

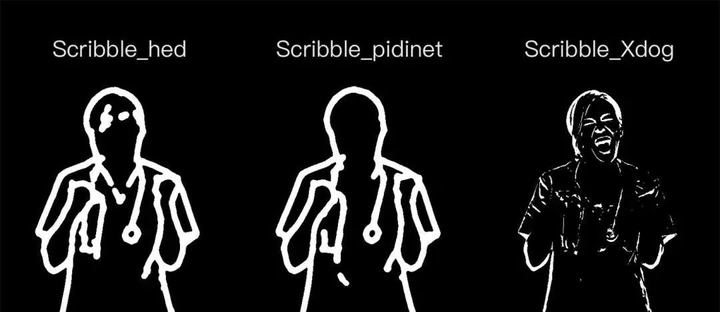

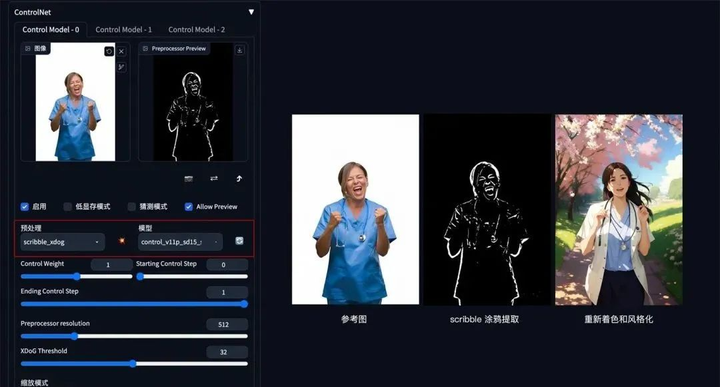

2. 涂鸦成图

方法:通过 ControlNet 的 Scribble 模型提取涂鸦图(可提取参考图涂鸦,或者手绘涂鸦图),再根据提示词和风格模型对图像进行着色和风格化。

应用模型:Scribble。

Scribble 比 Canny、SoftEdge 和 Lineart 的自由发挥度要更高,也可以用于对手绘稿进行着色和风格处理。Scribble 的预处理器有三种模式:Scribble_hed,Scribble_pidinet,Scribble_Xdog,对比如下,可以看到 Scribble_Xdog 的处理细节更为丰富:

Scribble 参考图提取示例(保留大致结构,再进行着色和风格化):

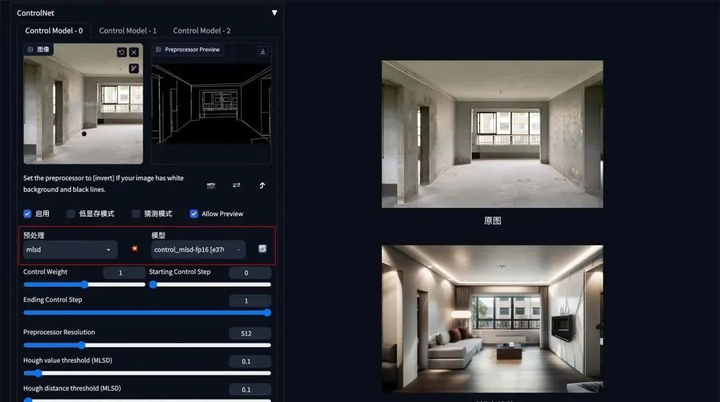

3. 建筑/室内设计

**方法:**通过 ControlNet 的 MLSD 模型提取建筑的线条结构和几何形状,构建出建筑线框(可提取参考图线条,或者手绘线条),再配合提示词和建筑/室内设计风格模型来生成图像。

**应用模型:**MLSD。

MLSD 示例:(毛坯变精装)

这份完整版的ControlNet 1.1模型我已经打包好,需要的点击下方插件,即可前往免费领取!

4. 颜色控制画面

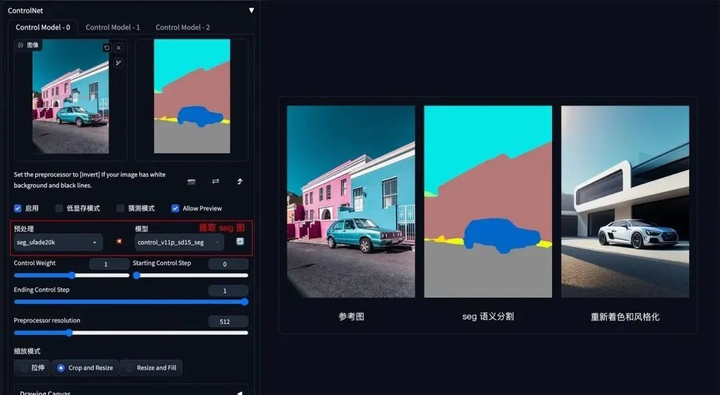

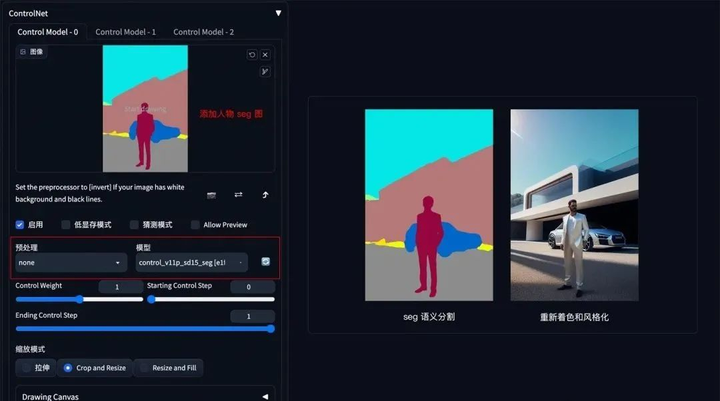

**方法:**通过 ControlNet 的 Segmentation 语义分割模型,标注画面中的不同区块颜色和结构(不同颜色代表不同类型对象),从而控制画面的构图和内容。

**应用模型:**Seg。

Seg 示例:(提取参考图内容和结构,再进行着色和风格化)

如果还想在车前面加一个人,只需在 Seg 预处理图上对应人物色值,添加人物色块再生成图像即可。

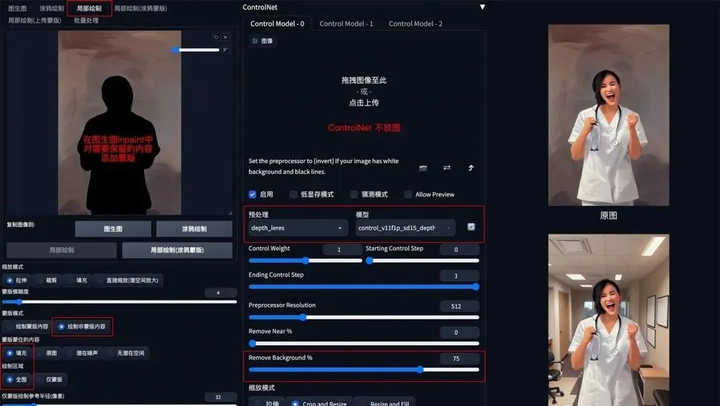

5. 背景替换

**方法:**在 img2img 图生图模式中,通过 ControlNet 的 Depth_leres 模型中的 remove background 功能移除背景,再通过提示词更换想要的背景。

**应用模型:**Depth,预处理器 Depth_leres。

**要点:**如果想要比较完美的替换背景,可以在图生图的 Inpaint 模式中,对需要保留的图片内容添加蒙版,remove background 值可以设置在 70-80%。

Depth_leres 示例:(将原图背景替换为办公室背景)

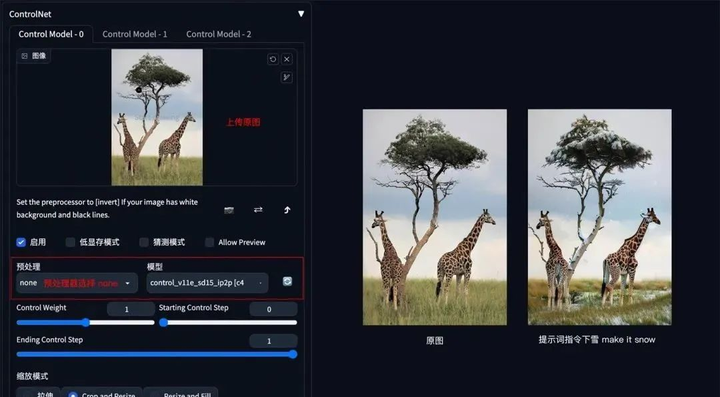

6. 图片指令

**方法:**通过 ControlNet 的 Pix2Pix 模型(ip2p),可以对图片进行指令式变换。

应用模型:ip2p,预处理器选择 none。

**要点:**采用指令式提示词(make Y into X),如下图示例中的 make it snow,让非洲草原下雪。

Pix2Pix 示例:(让非洲草原下雪)

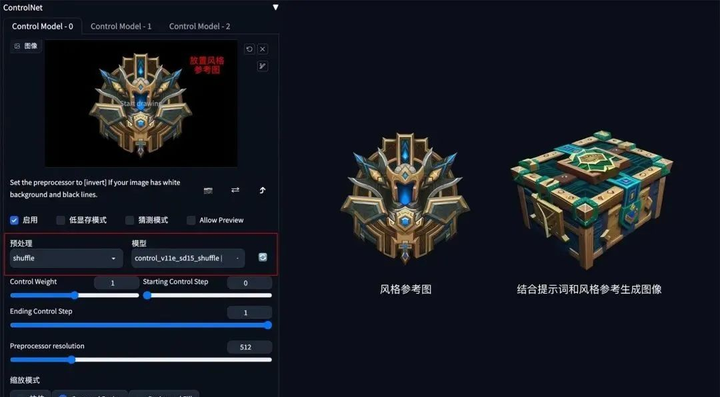

7. 风格迁移

**方法:**通过 ControlNet 的 Shuffle 模型提取出参考图的风格,再配合提示词将风格迁移到生成图上。

**应用模型:**Shuffle。

Shuffle 示例:(根据魔兽道具风格,重新生成一个宝箱道具)

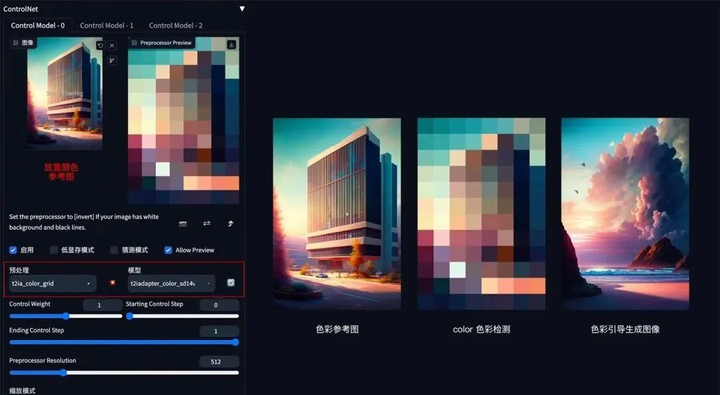

8. 色彩继承

**方法:**通过 ControlNet 的 t2iaColor 模型提取出参考图的色彩分布情况,再配合提示词和风格模型将色彩应用到生成图上。

**应用模型:**Color。

Color 示例:(把参考图色彩分布应用到生成图上)

这份完整版的ControlNet 1.1模型我已经打包好,需要的点击下方插件,即可前往免费领取!

这里就简单说几种应用:

1. 人物和背景分别控制

2. 三维重建

3. 更精准的图片风格化

4. 更精准的图片局部重绘

以上就是本教程的全部内容了,重点介绍了controlnet模型功能实用,当然还有一些小众的模型在本次教程中没有出现,目前controlnet模型确实还挺多的,所以重点放在了官方发布的几个模型上。

同时大家可能都想学习AI绘画技术,也想通过这项技能真正赚到钱,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学,因为自身做副业需要,我这边整理了全套的Stable Diffusion入门知识点资料,大家有需要可以直接点击下边卡片获取,希望能够真正帮助到大家。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)