【MCP探索实践】Cherry Studio+MCP实战:3步让AI自动抓网页读文件调API_cherry studio 数据库操作 网页信息读取

在人工智能飞速发展的今天,AI 模型的应用场景不断拓展,但同时也面临着诸多挑战,例如如何让 AI 模型更好地与外部资源进行交互和协作。MCP(Model Context Protocol,模型上下文协议)作为一种新兴的接口协议,为解决这一问题提供了新的思路。而 Cherry Studio 作为一款功能强大的 AI 桌面客户端,其与 MCP 的融合更是为 AI 开发和应用带来了全新的机遇。

目录

- 系列篇章💥

- 前言

- 一、总体概述

-

- (一)什么是 MCP?

- (二)Cherry Studio 简介

- (三)Cherry Studio 与 MCP 的融合

- 二、技术优势

-

- (一)即插即用

- (二)热插拔

- (三)统一接口

- (四)高效的数据交互

- 三、应用场景

-

- (一)本地文件操作

- (二)网页数据抓取

- (三)云端 API 调用

- (四)数据分析与可视化

- (五)自动化任务

- 四、实战体验

-

- (一) 安装MCP服务器

- (二)配置 MCP服务器

- (三)启用 MCP 服务

- (四)使用 Fetch 工具抓取网页内容

- (五)使用 Filesystem 工具操作本地文件

- 总结

前言

在人工智能飞速发展的今天,AI 模型的应用场景不断拓展,但同时也面临着诸多挑战,例如如何让 AI 模型更好地与外部资源进行交互和协作。MCP(Model Context Protocol,模型上下文协议)作为一种新兴的接口协议,为解决这一问题提供了新的思路。而 Cherry Studio 作为一款功能强大的 AI 桌面客户端,其与 MCP 的融合更是为 AI 开发和应用带来了全新的机遇。本文将详细介绍 Cherry Studio 与 MCP 的融合实践,包括技术优势、多应用场景实践以及总结,旨在帮助开发者更好地理解和应用这一技术。

一、总体概述

(一)什么是 MCP?

MCP 是一种接口协议,由 AI 大模型公司 Anthropic 在 2024 年 11 月推出。它允许大型语言模型(LLM)通过调用外部工具和服务获取实时信息,从而扩展其能力。MCP 的核心在于它能够将 AI 模型与各种外部资源(如数据源、工具、API 等)连接起来,让 AI 模型能够像使用“USB 接口”一样,即插即用地与这些资源进行交互。

(二)Cherry Studio 简介

Cherry Studio 是一款功能全面的 AI 桌面客户端,以其友好的用户界面和易用性深受用户喜爱。它支持多种 AI 模型,并提供了丰富的功能和工具,帮助用户更高效地进行 AI 开发和应用。近期,Cherry Studio 开始支持 MCP 服务,这使得它能够更好地利用 MCP 协议的优势,为用户提供更强大的 AI 功能。

(三)Cherry Studio 与 MCP 的融合

Cherry Studio 与 MCP 的融合,使得用户可以在 Cherry Studio 中轻松配置和使用 MCP 服务。通过这种方式,用户可以让 AI 模型访问本地文件、调用云端 API、抓取网页数据等,极大地扩展了 AI 模型的应用范围。这种融合不仅提升了 AI 模型的灵活性和实用性,还降低了开发难度,让更多的开发者能够快速上手并应用这一技术。

二、技术优势

(一)即插即用

MCP 协议的核心优势之一是即插即用。无论是本地文件、数据库,还是云端 API,只需接入 MCP,即可直接使用,无需编写复杂的适配代码。这大大简化了开发流程,提高了开发效率。

(二)热插拔

MCP 支持热插拔,即在运行时可以随时添加或移除数据源。系统会自动识别新的数据源,无需重启服务。这一特性使得 AI 模型能够更加灵活地应对不同的需求,随时调整其功能和行为。

(三)统一接口

MCP 提供了统一的接口,支持连接各种类型的 AI 模型和工具。这意味着开发者可以使用相同的接口与不同的资源进行交互,无需为每种资源编写特定的代码。这种统一性不仅提高了开发效率,还增强了系统的可扩展性和互操作性。

(四)高效的数据交互

MCP 支持两种传输协议:STDIO(标准输入/输出)和 SSE(服务器发送事件)。STDIO 类型可以在本地运行,能够直接访问本机文件和应用程序,而 SSE 类型则运行在远程服务器上,配置简单,适合获取云端数据和调用在线 API。这种灵活的协议选择使得开发者可以根据具体需求选择最适合的传输方式。

三、应用场景

(一)本地文件操作

通过 MCP,Cherry Studio 中的 AI 模型可以直接访问和操作本地文件。例如,用户可以让 AI 模型读取本地的文档、表格,进行数据分析和内容提取。这使得 AI 模型能够更好地与本地资源进行交互,为用户提供更个性化的服务。

(二)网页数据抓取

MCP 还支持网页数据抓取,用户可以让 AI 模型通过 Fetch 工具获取网页内容。例如,用户可以指定一个网页链接,让 AI 模型抓取该网页的内容并进行分析。这使得 AI 模型能够获取最新的网络信息,为用户提供更准确的建议。

(三)云端 API 调用

借助 MCP,Cherry Studio 中的 AI 模型可以轻松调用云端 API。例如,用户可以配置 MCP 服务,让 AI 模型调用天气 API 获取实时天气信息。这种云端 API 调用使得 AI 模型能够获取更广泛的数据,从而提供更全面的服务。

(四)数据分析与可视化

结合 MCP,Cherry Studio 可以实现数据分析与可视化。用户可以将本地或云端的数据导入 Cherry Studio,然后利用 AI 模型进行数据分析。分析结果可以通过可视化工具展示出来,帮助用户更好地理解数据。

(五)自动化任务

Cherry Studio 与 MCP 的结合还可以实现自动化任务。例如,用户可以配置 AI 模型定期从云端 API 获取数据,并自动更新本地文件或数据库。这种自动化功能可以大大提高工作效率,减少人工干预。

四、实战体验

(一) 安装MCP服务器

在开始配置 MCP 服务之前,需要确保已安装必要的运行环境。提前下载安装Cherry Studio,

下载地址:https://github.com/CherryHQ/cherry-studio/releases/download/v1.1.17/Cherry-Studio-1.1.17-setup.exe

其他系统版本请访问:https://docs.cherry-ai.com/cherry-studio/download

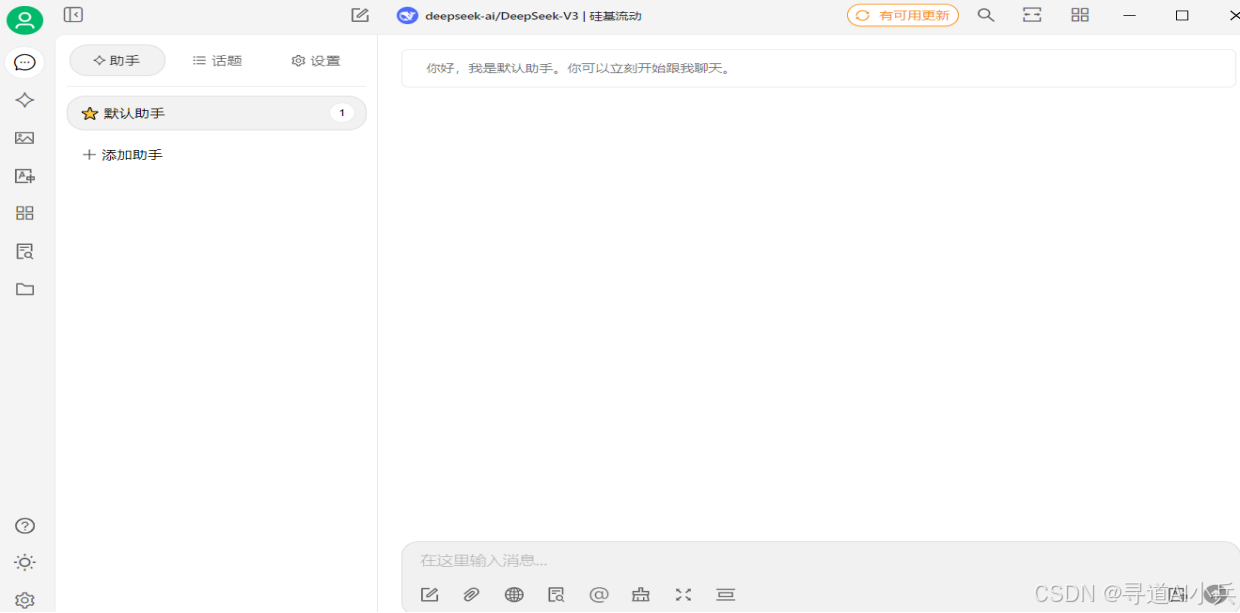

单击Cherry-Studio-1.1.17-setup.exe即可安装(一路下一步,安装完成打开界面如下:)

(二)配置 MCP服务器

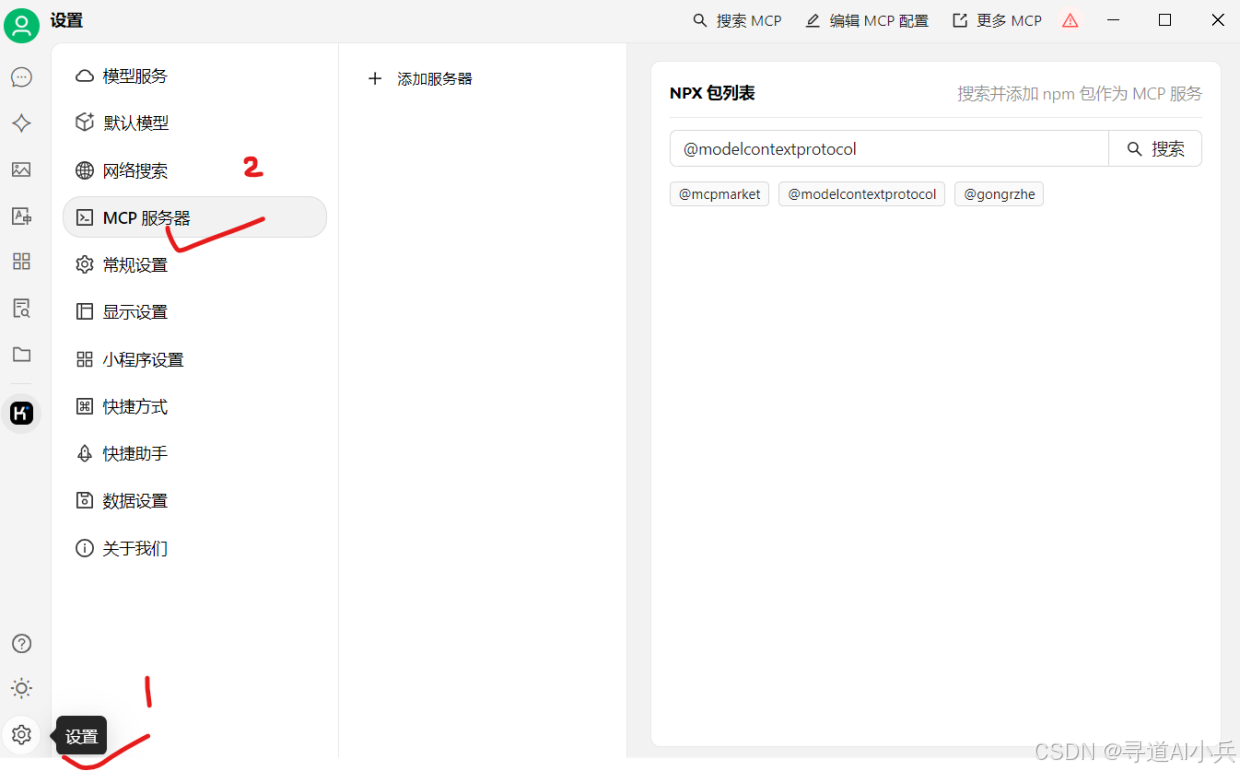

添加 MCP 服务器:打开 Cherry Studio,进入设置页面,找到“MCP 服务器”选项。

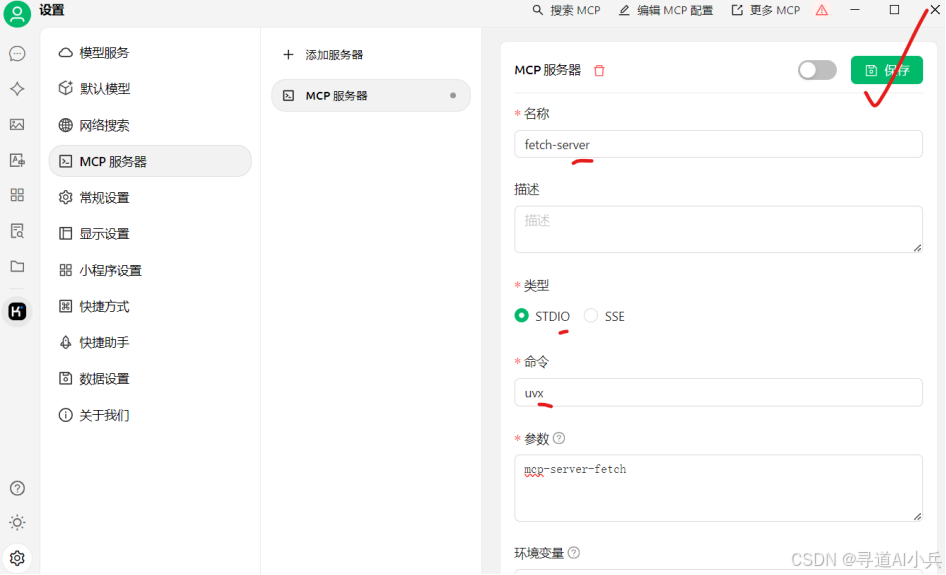

点击“添加服务器”,填写相关参数。例如,添加一个 fetch-server:

- 名称:

fetch-server - 类型:

STDIO - 命令:

uvx - 参数:

mcp-server-fetch

点击“确定”保存配置。Cherry Studio 将自动下载所需的 MCP Server。

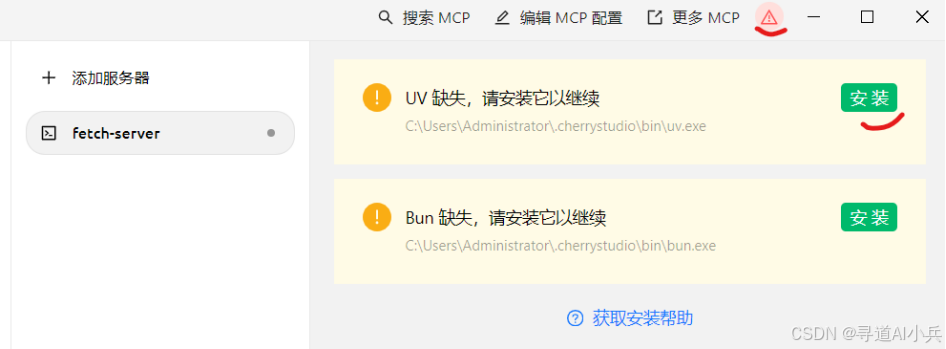

安装相关依赖工具,按照提醒,安装UV和Bun

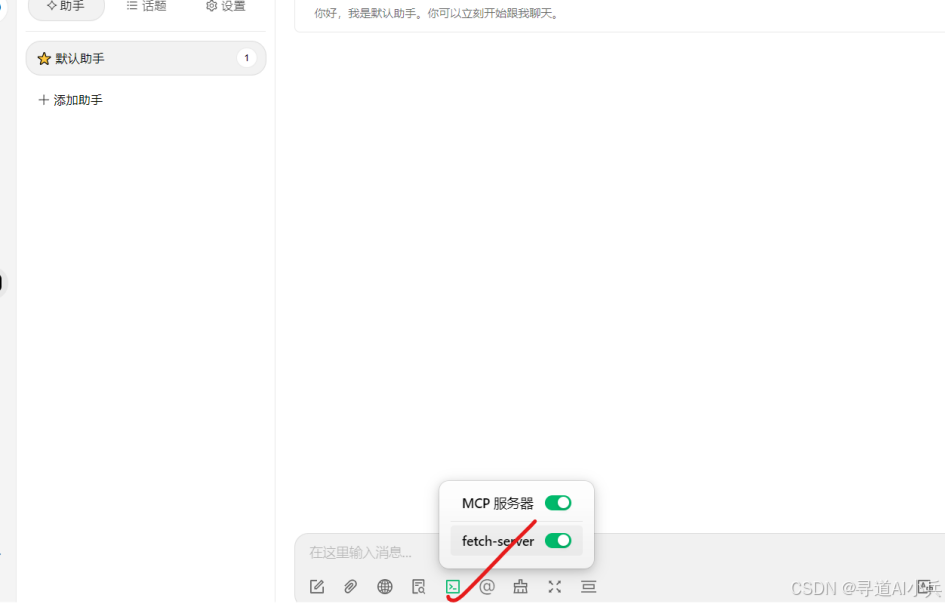

(三)启用 MCP 服务

在聊天框中启用 MCP 服务需要满足以下条件:

- 使用支持函数调用的模型(模型名字后会出现扳手符号)。

- 已成功添加 MCP 服务器。

启用后,可以在聊天框中直接使用 MCP 功能,例如通过 Fetch 工具抓取网页内容。

(四)使用 Fetch 工具抓取网页内容

在聊天框中输入指令,例如:“请从 [网页链接] 获取最新内容并总结”。

如果配置成功,AI 将从指定网页抓取内容并返回总结。效果如下:

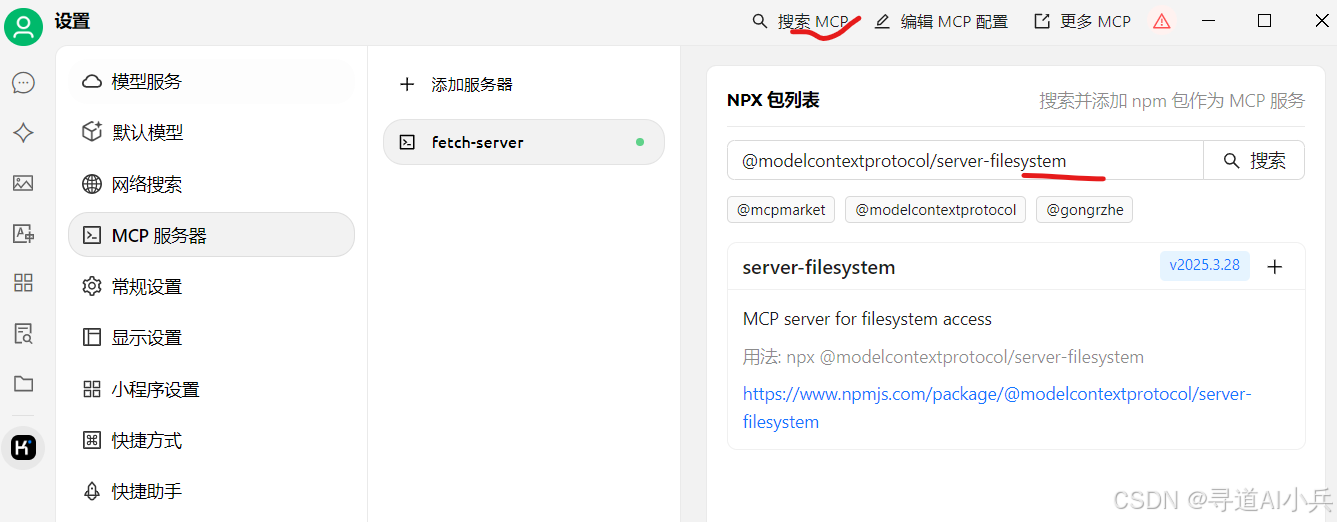

(五)使用 Filesystem 工具操作本地文件

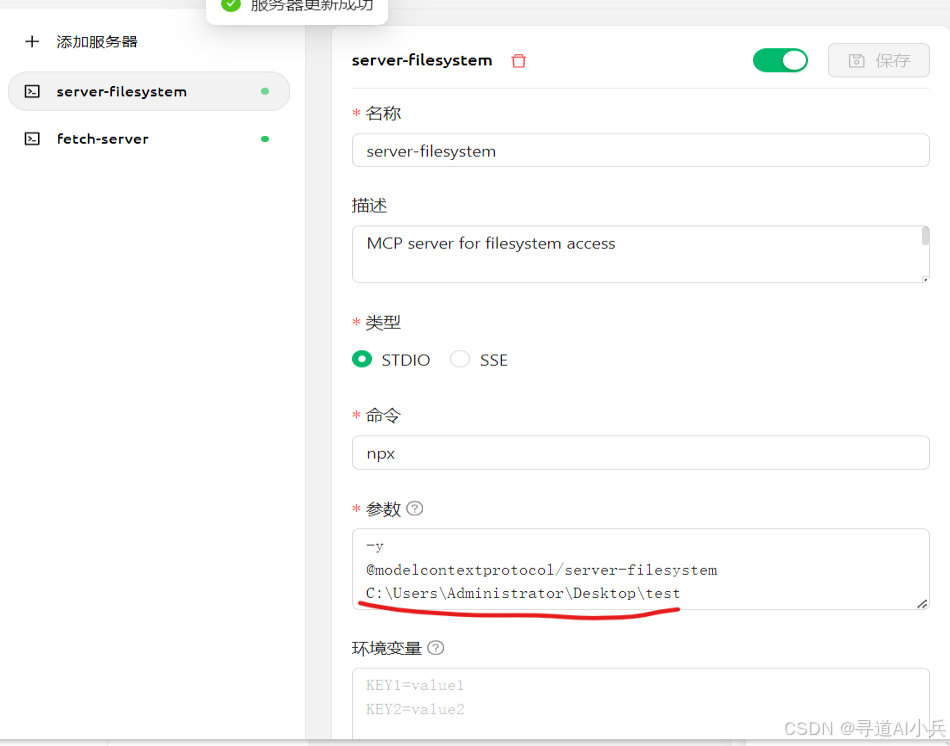

1)配置 Filesystem 服务

在 MCP 服务器配置中,点击“添加服务器”,搜索并选择 @modelcontextprotocol/server-filesystem。 点击“+”添加到服务器列表。

在弹出框中编辑服务器信息,填写操作目录路径(例如 C:\Users\Administrator\Desktop\test),点击“确定”。

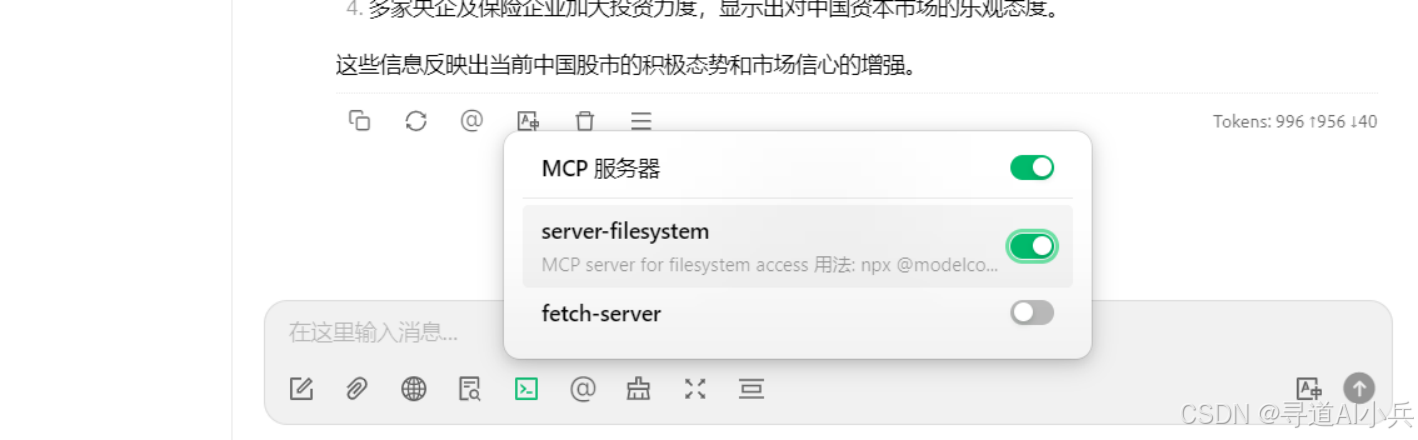

启用Filesystem 工具服务

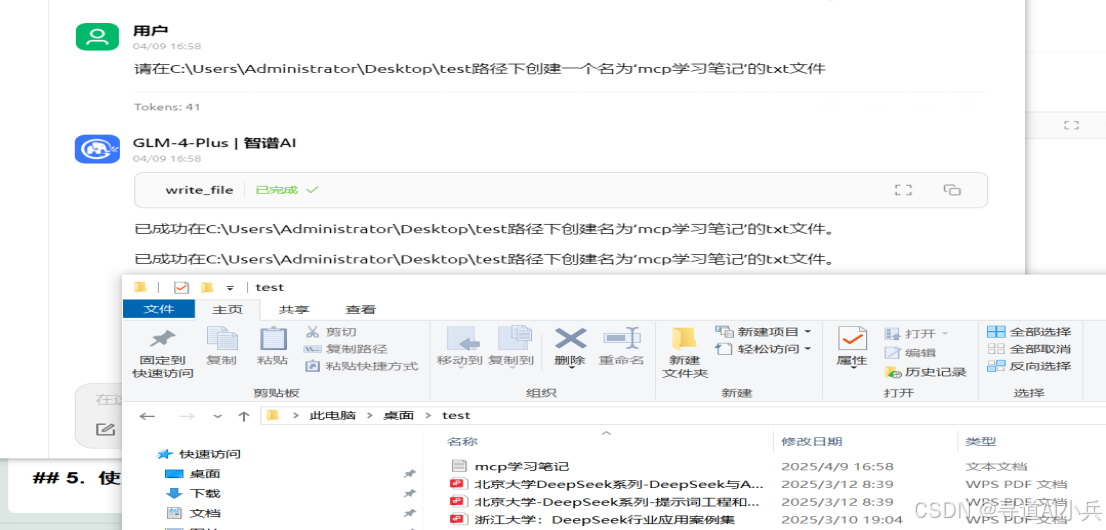

启用 Filesystem 服务后;在聊天框中输入指令,例如:“请问C:\Users\Administrator\Desktop\test目录下有几个文件,列出文件名”

例如:“请在C:\Users\Administrator\Desktop\test路径下创建一个名为‘mcp学习笔记’的txt文件”。

打开文件,你会发现已成功在C:\Users\Administrator\Desktop\test路径下创建名为‘mcp学习笔记’的txt文件。

其他更多MCP服务可查看:https://github.com/punkpeye/awesome-mcp-servers

总结

MCP 协议是 AI 开发领域的一项重要创新,它通过统一的接口连接 AI 模型与各种资源,实现了“即插即用”的开发体验。借助 Cherry Studio,开发者可以轻松配置和使用 MCP,无论是本地文件、云端 API,还是网页数据,都能高效集成,大幅提升开发效率。这种融合不仅降低了开发难度,还为 AI 模型的应用带来了更多的可能性。未来,随着 MCP 协议的不断发展和完善,相信它将在更多的领域发挥重要作用,为 AI 开发带来更多的便利和创新。

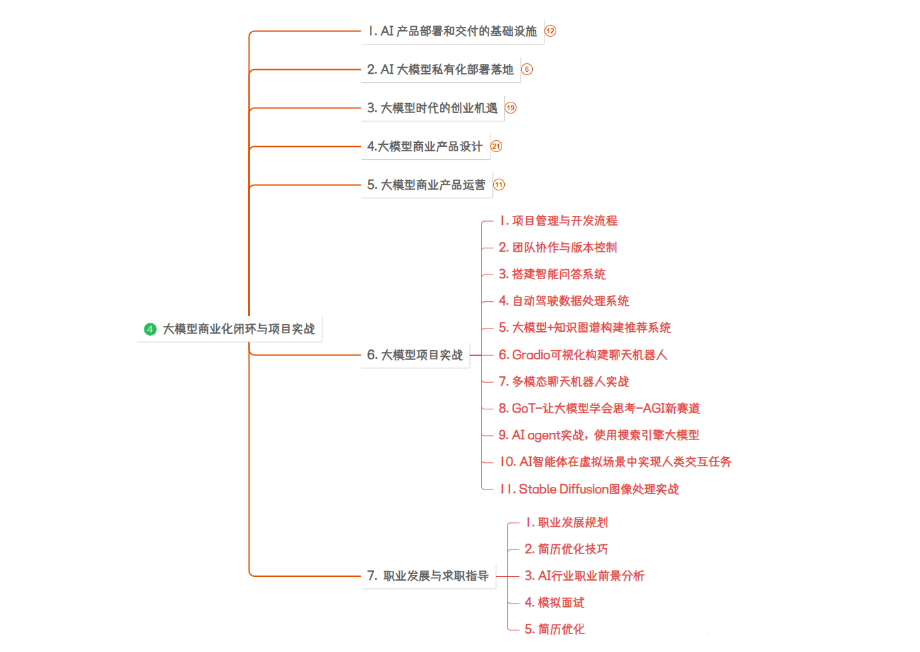

大模型岗位需求

大模型时代,企业对人才的需求变了,AIGC相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

零基础入门AI大模型

今天贴心为大家准备好了一系列AI大模型资源,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

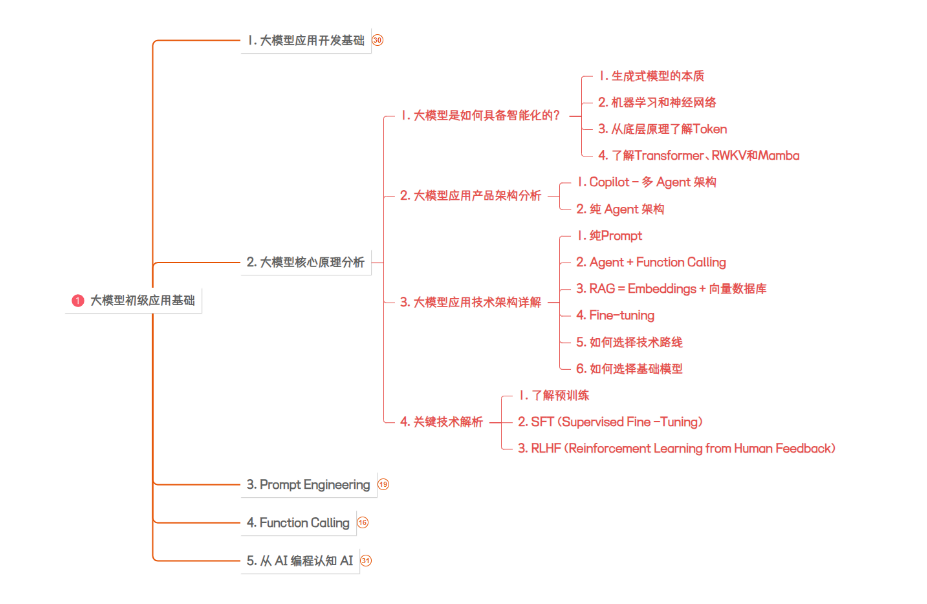

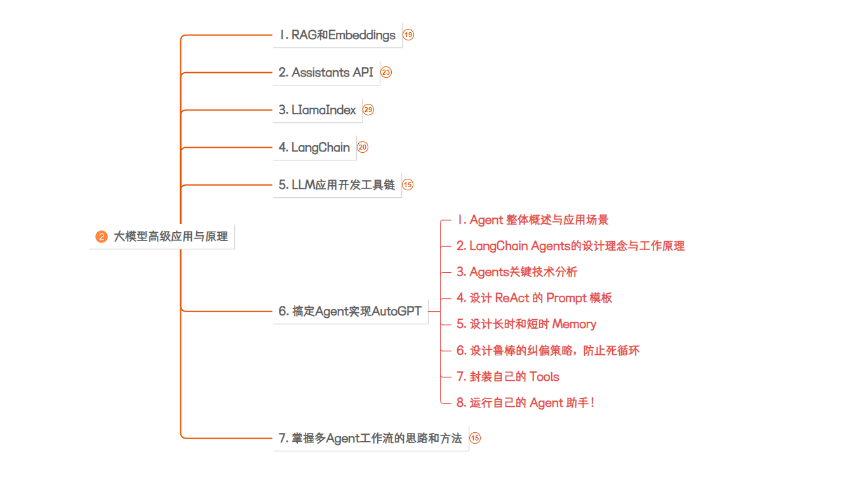

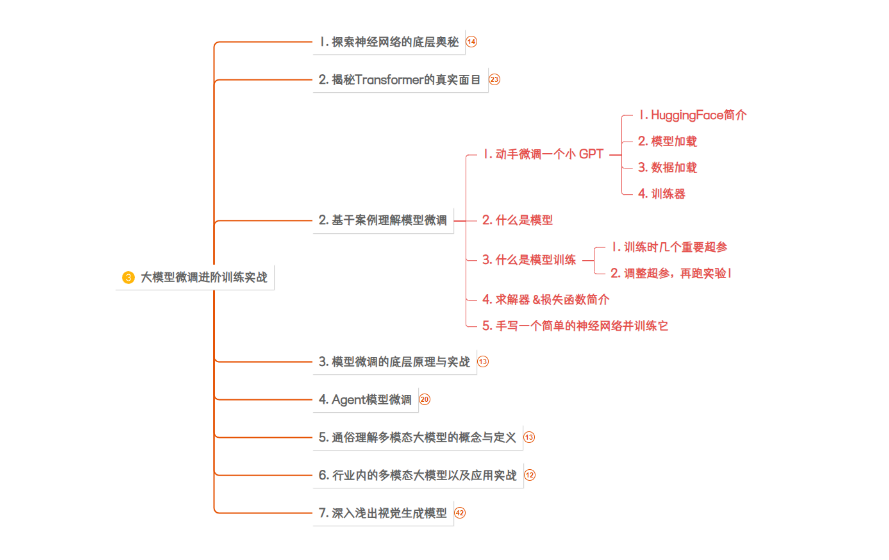

1.学习路线图

如果大家想领取完整的学习路线及大模型学习资料包,可以扫下方二维码获取

👉2.大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。(篇幅有限,仅展示部分)

大模型教程

👉3.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(篇幅有限,仅展示部分,公众号内领取)

电子书

👉4.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(篇幅有限,仅展示部分,公众号内领取)

大模型面试

**因篇幅有限,仅展示部分资料,**有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

**或扫描下方二维码领取 **

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)