复旦大学《大规模语言模型:从理论到实践》完整PDF和PPT课件下载

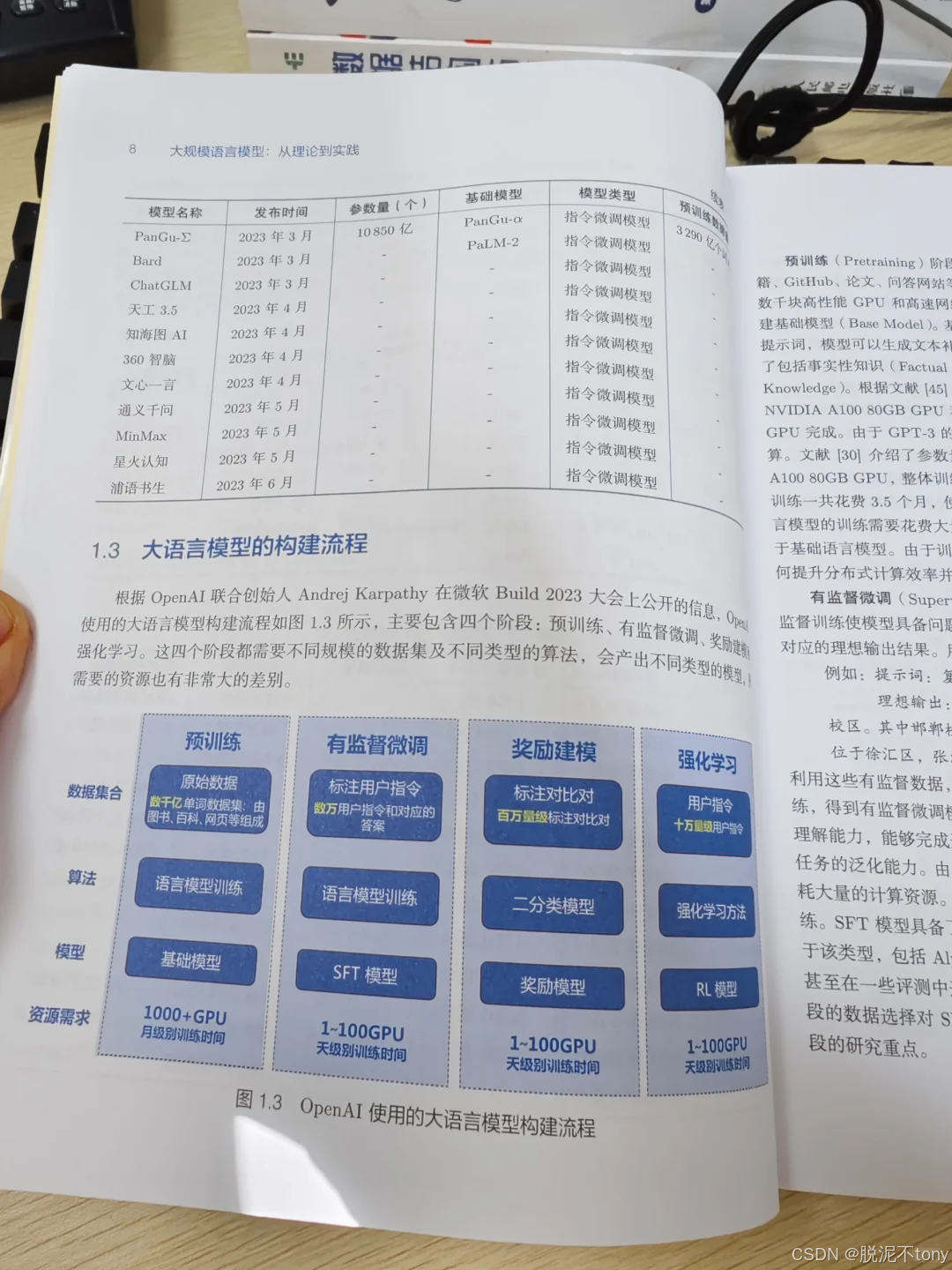

大规模语言模型:从理论到实践》详细介绍了构建大语言模型的四个主要阶段:预训练、有监督微调、奖励建模和强化学习。每个阶段都有算法、代码、数据、难点及实践经验的详细讨论。《大规模语言模型:从理论到实践》以大语言模型的基础理论开篇,探讨了大语言模型预训练数据的构建方法,以及大语言模型如何理解并服从人类指令,介绍了大语言模型的应用和评估方法,为读者提供了更全面的视野。《大规模语言模型:从理论到实践》旨在为

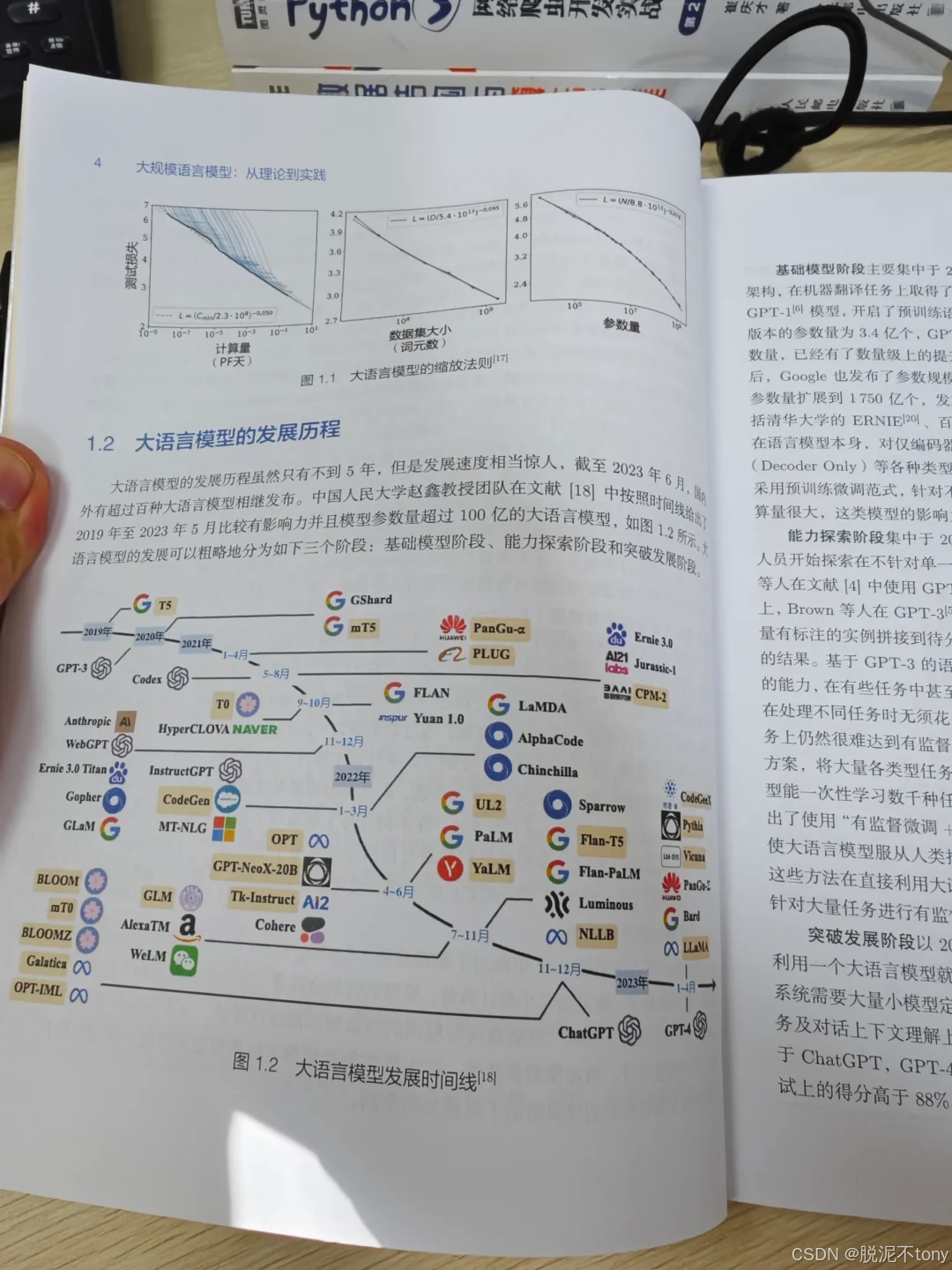

大语言模型(Large Language Models,LLM)是一种由包含数百亿以上权重的深度神经网络构建的语言模型,使用自监督学习方法通过大量无标记文本进行训练。自2018年以来,包含Google、OpenAI、Meta、百度、华为等公司和研究机构都纷纷发布了包括BERT, GPT等在内多种模型,并在几乎所有自然语言处理任务中都表现出色。2021年开始大模型呈现爆发式的增长,特别是2022年11月ChatGPT发布后,更是引起了全世界的广泛关注。用户可以使用自然语言与系统交互,从而实现包括问答、分类、摘要、翻译、聊天等从理解到生成的各种任务。大型语言模型展现出了强大的对世界知识掌握和对语言的理解。本书将介绍大语言模型的基础理论包括语言模型、分布式模型训练以及强化学习,并以Deepspeed-Chat框架为例介绍实现大语言模型和类ChatGPT系统的实践。

内容简介

《大规模语言模型:从理论到实践》详细介绍了构建大语言模型的四个主要阶段:预训练、有监督微调、奖励建模和强化学习。每个阶段都有算法、代码、数据、难点及实践经验的详细讨论。

《大规模语言模型:从理论到实践》以大语言模型的基础理论开篇,探讨了大语言模型预训练数据的构建方法,以及大语言模型如何理解并服从人类指令,介绍了大语言模型的应用和评估方法,为读者提供了更全面的视野。

《大规模语言模型:从理论到实践》旨在为对大语言模型感兴趣的读者提供入门指南,也可作为高年级本科生和研究生自然语言处理相关课程的补充教材。

这本大模型《大规模语言模型:从理论到实践》已经上传CSDN,还有完整版的大模型 AI 学习资料,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

PDF书籍: 完整版本链接获取

👉[CSDN大礼包🎁:《

大规模语言模型:从理论到实践》免费分享(安全链接,放心点击)]👈

第1章 绪论 1

1.1 大语言模型的基本概念 1

1.2 大语言模型的发展历程 4

1.3 大语言模型的构建流程 8

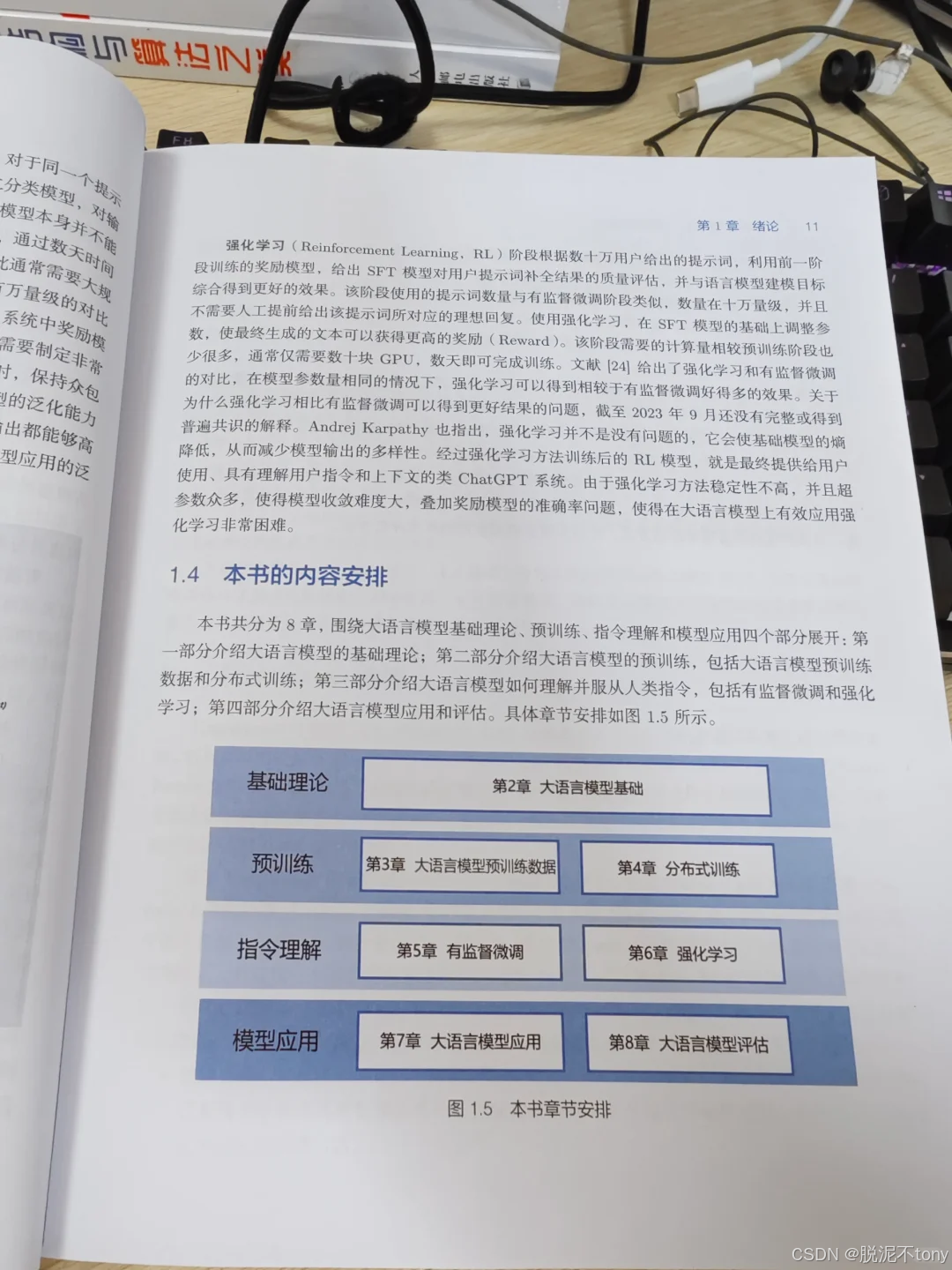

1.4 本书的内容安排 11

第2章 大语言模型基础 13

2.1 Transformer结构 13

2.1.1 嵌入表示层 14

2.1.2 注意力层 16

2.1.3 前馈层 18

2.1.4 残差连接与层归一化 19

2.1.5 编码器和解码器结构 20

2.2 生成式预训练语言模型GPT 25

2.2.1 无监督预训练 26

2.2.2 有监督下游任务微调 27

2.2.3 基于HuggingFace的预训练语言模型实践 27

2.3 大语言模型的结构 33

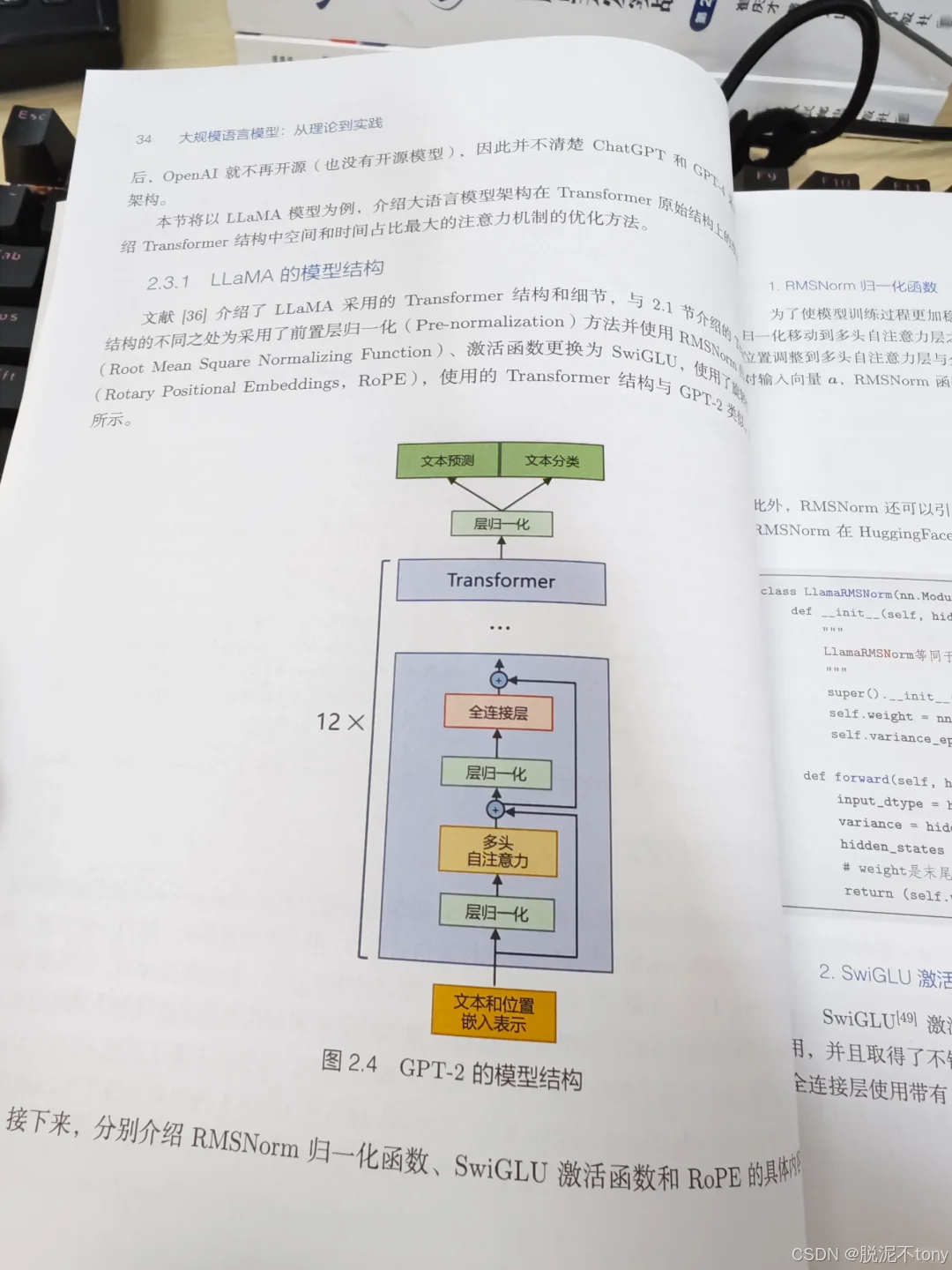

2.3.1 LLaMA的模型结构 34

2.3.2 注意力机制优化 40

2.4 实践思考 47

第3章 大语言模型预训练数据 49

3.1 数据来源 49

3.1.1 通用数据 50

3.1.2 专业数据 51

3.2 数据处理 52

3.2.1 质量过滤 52

3.2.2 冗余去除 53

3.2.3 隐私消除 55

3.2.4 词元切分 55

3.3 数据影响分析 61

3.3.1 数据规模 61

3.3.2 数据质量 64

3.3.3 数据多样性 66

3.4 开源数据集 68

3.4.1 Pile 68

3.4.2 ROOTS 71

3.4.3 RefinedWeb 73

3.4.4 SlimPajama 75

3.5 实践思考 79

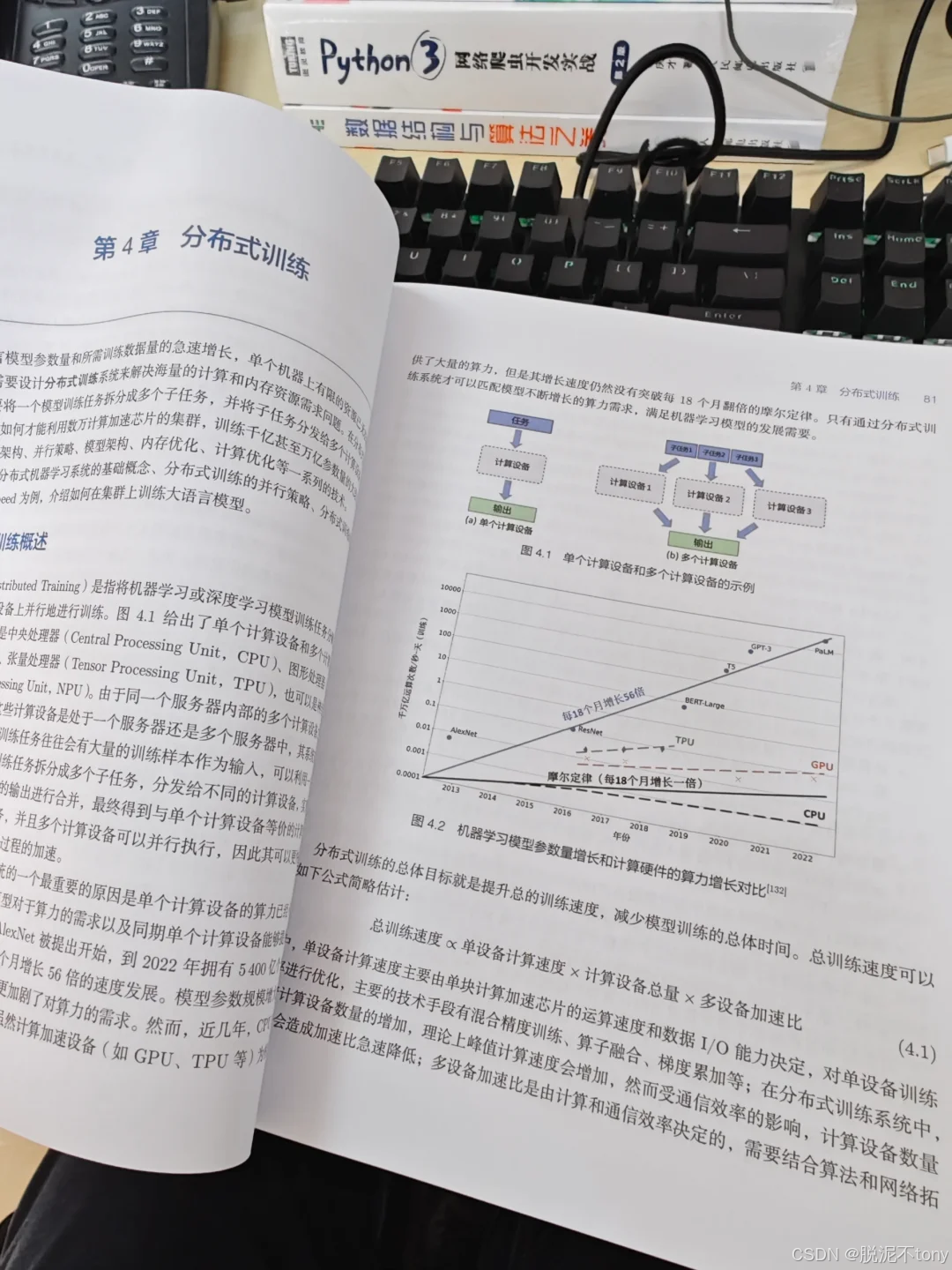

第4章 分布式训练 80

4.1 分布式训练概述 80

4.2 分布式训练的并行策略 83

4.2.1 数据并行 84

4.2.2 模型并行 88

4.2.3 混合并行 96

4.2.4 计算设备内存优化 97

4.3 分布式训练的集群架构 102

4.3.1 高性能计算集群的典型硬件组成 102

4.3.2 参数服务器架构 103

4.3.3 去中心化架构 104

4.4 DeepSpeed实践 110

4.4.1 基础概念 112

4.4.2 LLaMA分布式训练实践 115

4.5 实践思考 127

第5章 有监督微调 128

5.1 提示学习和语境学习 128

5.1.1 提示学习 128

5.1.2 语境学习 130

5.2 高效模型微调 131

5.2.1 LoRA 131

5.2.2 LoRA的变体 135

5.3 模型上下文窗口扩展 137

5.3.1 具有外推能力的位置编码 137

5.3.2 插值法 138

5.4 指令数据的构建 141

5.4.1 手动构建指令 141

5.4.2 自动构建指令 142

5.4.3 开源指令数据集 146

5.5 DeepSpeed-Chat SFT实践 147

5.5.1 代码结构 148

5.5.2 数据预处理 151

5.5.3 自定义模型 153

5.5.4 模型训练 155

5.5.5 模型推理 156

5.6 实践思考 157

第6章 强化学习 158

6.1 基于人类反馈的强化学习 158

6.1.1 强化学习概述 159

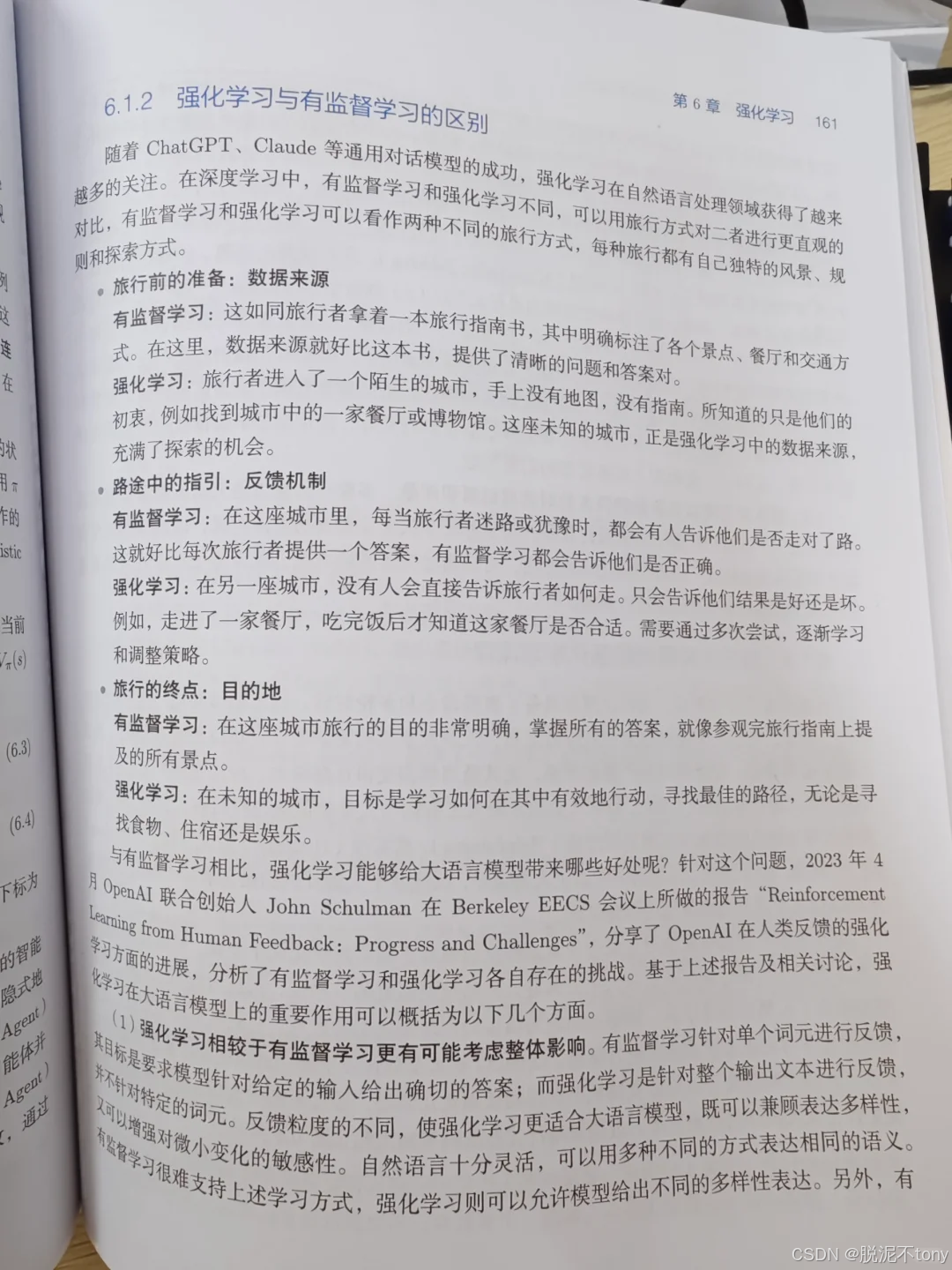

6.1.2 强化学习与有监督学习的区别 161

6.1.3 基于人类反馈的强化学习流程 162

6.2 奖励模型 163

6.2.1 数据收集 164

6.2.2 模型训练 166

6.2.3 开源数据 167

6.3 近端策略优化 168

6.3.1 策略梯度 168

6.3.2 广义优势估计 173

6.3.3 近端策略优化算法 175

6.4 MOSS-RLHF实践 180

6.4.1 奖励模型训练 180

6.4.2 PPO微调 181

6.5 实践思考 191

第7章 大语言模型应用 193

7.1 推理规划 193

7.1.1 思维链提示 193

7.1.2 由少至多提示 196

7.2 综合应用框架 197

7.2.1 LangChain框架核心模块 198

7.2.2 知识库问答系统实践 216

7.3 智能代理 219

7.3.1 智能代理的组成 219

7.3.2 智能代理的应用实例 221

7.4 多模态大语言模型 228

7.4.1 模型架构 229

7.4.2 数据收集与训练策略 232

7.4.3 多模态能力示例 236

7.5 大语言模型推理优化 238

7.5.1 FastServe框架 241

7.5.2 vLLM推理框架实践 242

7.6 实践思考 244

第8章 大语言模型评估 245

8.1 模型评估概述 245

8.2 大语言模型评估体系 247

8.2.1 知识与能力 247

8.2.2 伦理与安全 250

8.2.3 垂直领域评估 255

8.3 大语言模型评估方法 260

8.3.1 评估指标 260

8.3.2 评估方法 267

8.4 大语言模型评估实践 274

8.4.1 基础模型评估 274

8.4.2 SFT模型和RL模型评估 277

8.5 实践思考 282

参考文献 284

索引 303

这本大模型《大规模语言模型:从理论到实践》已经上传CSDN,还有完整版的大模型 AI 学习资料,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

PDF书籍: 完整版本链接获取

👉[CSDN大礼包🎁:《

大规模语言模型:从理论到实践》免费分享(安全链接,放心点击)]👈

更多推荐

已为社区贡献75条内容

已为社区贡献75条内容

所有评论(0)