服务器挤爆?10分钟搞定DeepSeek本地部署,离线玩转顶尖大模型,赶紧收藏!

从上个月20号DeepSeek推出R1推理模型以来,DeepSeek一直频繁刷圈,一方面是来自行内行外的各个用户想尝试体验DeepSeek的强大能力,另一方面来自国外的黑客团队的恶意攻击,DeepSeek短期内迎来泼天流量,服务器承载不住,服务器的状态也让很多小伙伴们抓狂,注册限制、使用次数限制、访问不稳定、服务器繁忙……让很多想尝试一下国产之光的小伙伴们望屏兴叹。

从上个月20号DeepSeek推出R1推理模型以来,DeepSeek一直频繁刷圈,一方面是来自行内行外的各个用户想尝试体验DeepSeek的强大能力,另一方面来自国外的黑客团队的恶意攻击,DeepSeek短期内迎来泼天流量,服务器承载不住,服务器的状态也让很多小伙伴们抓狂,注册限制、使用次数限制、访问不稳定、服务器繁忙……让很多想尝试一下国产之光的小伙伴们望屏兴叹。

东哥也感同身受,爱折腾的我当然不会被这个难题给困住,于是倒腾了一阵,摸索出了面向小白的本地部署方案,让每个人都能在自己的电脑上轻松玩转DeepSeek。

这样就完全不用再受到DeepSeek在线服务器的影响,只要电脑开机,就能一直随心运行使用DeepSeek服务啦!

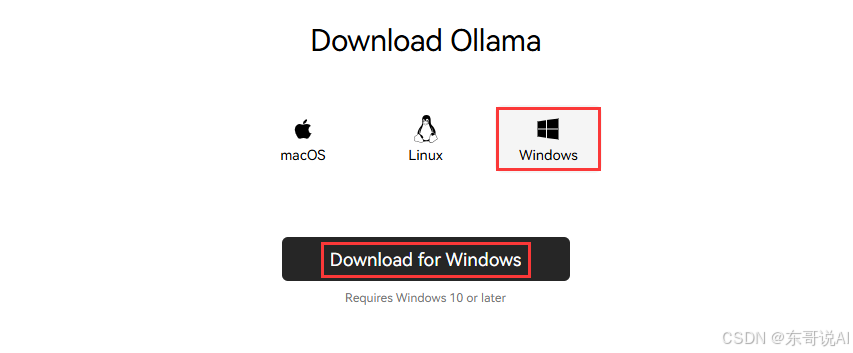

1.下载安装Ollama

Ollama是一个本地管理启动大模型的工具,以安装简洁、易于使用著称,新手也可以快速上手,通过便捷的命令行操作,用户可以轻松管理和运行大语言模型(LLM)。

同时,Ollama支持Windows、MacOS、Linux等多种系统(下文以Windows系统为例进行演示),可以满足不同用户在不同操作系统上的部署需求。

官网下载地址:https://ollama.com/download

选择合适的版本进行下载:

如果下载缓慢或者无法打开页面,可以点击下方链接获取本文所涉及所有软件最新版(Ollama、以及下文涉及的Chatbox)的下载地址:

https://pan.baidu.com/s/1K7Ah4S6wSwfFe4V00TGpzQ?pwd=8vyt

下载好之后,直接安装包即可开始安装,安装过程不需要进行人工介入、一键即可完成安装,默认情况下会直接安装到C盘。

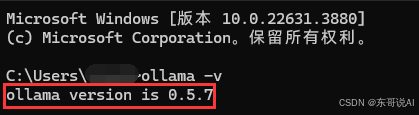

安装完成后,打开命令行(终端)(可以快捷键Win+R输入cmd或wt快速打开),输入ollama -v即可快速验证Ollama是否安装成功,示例如下:

如果显示了当前的版本号,即说明Ollama安装成功。

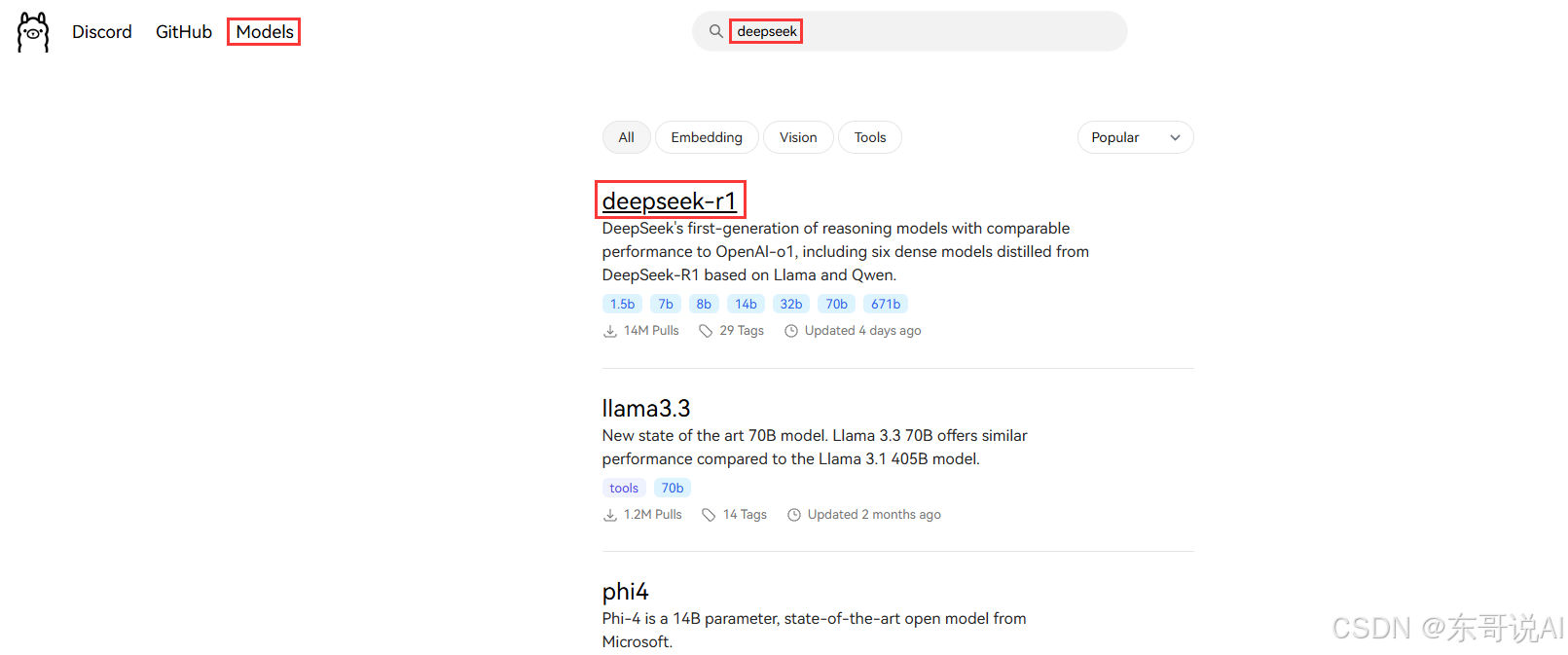

2.选择、下载DeepSeek模型

Ollama的官网有专门的Models模型页面https://ollama.com/models,目前页面的第1个模型就是DeepSeek,也可以搜索DeepSeek:

即可进入DeepSeek模型详情页https://ollama.com/library/deepseek-r1:

有全量的671B模型,也有蒸馏的小模型。

对于个人电脑来说,以24G显存为例,亲测可以不带明显延迟地运行32B的模型,如果你的电脑GPU配置更高,可以尝试更大的模型,如果GPU配置更低,可以尝试更小的模型,如果没有GPU,也可以使用Ollama基于CPU运行模型,只不过会相对会慢一些,因此它非常适合那些没有高端显卡的用户,MacOS可以使用Ollama也是这个原因。可以说,Ollama降低了普通用户本地部署大模型的门槛。

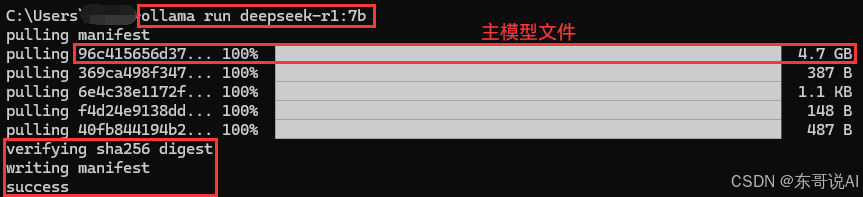

这里以7B模型为例,选择好模型后复制对应的命令并粘贴到命令行执行,例如ollama run deepseek-r1:7b,将模型下载到本地并启动模型,如下:

如果出现success的标志,则说明模型下载并启动成功。此时就可以在命令行与DeepSeek大模型对话了!

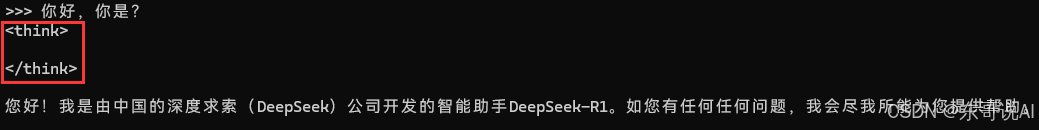

可以看到,DeepSeek R1系列模型在响应时,默认是带思考过程的。

3.安装Chatbox对话界面

虽然可以在本地命令行与DeepSeek对话,但是还是不够直观,此时如果有一个类似于ChatGPT、豆包一样的对话界面,可以提高交互性,体验会更好。Chatbox是一个AI客户端应用和智能助手,支持集成各大AI模型和API,同时兼容Windows、MacOS、Android、iOS、Linux和网页版等各平台,因此可以将部署的Ollama服务接入Chatbox,这样就可以在Chatbox的对话窗口对话了,这里选择安装Windows客户端进行演示。

首先打开Chatbox主页https://chatboxai.app/zh下载对应的版本:

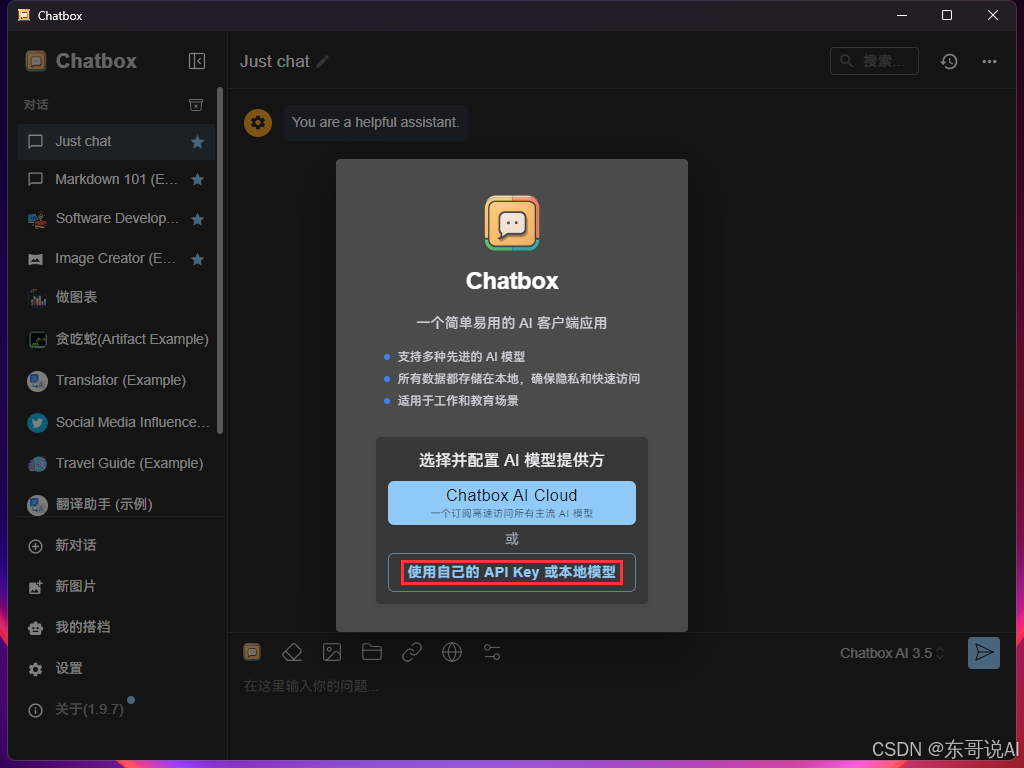

下载后选择合适的安装位置(推荐非系统盘)进行安装,安装好后,如果使用部署好的Ollama服务,则选择点击使用自己的API Key 或本地模型:

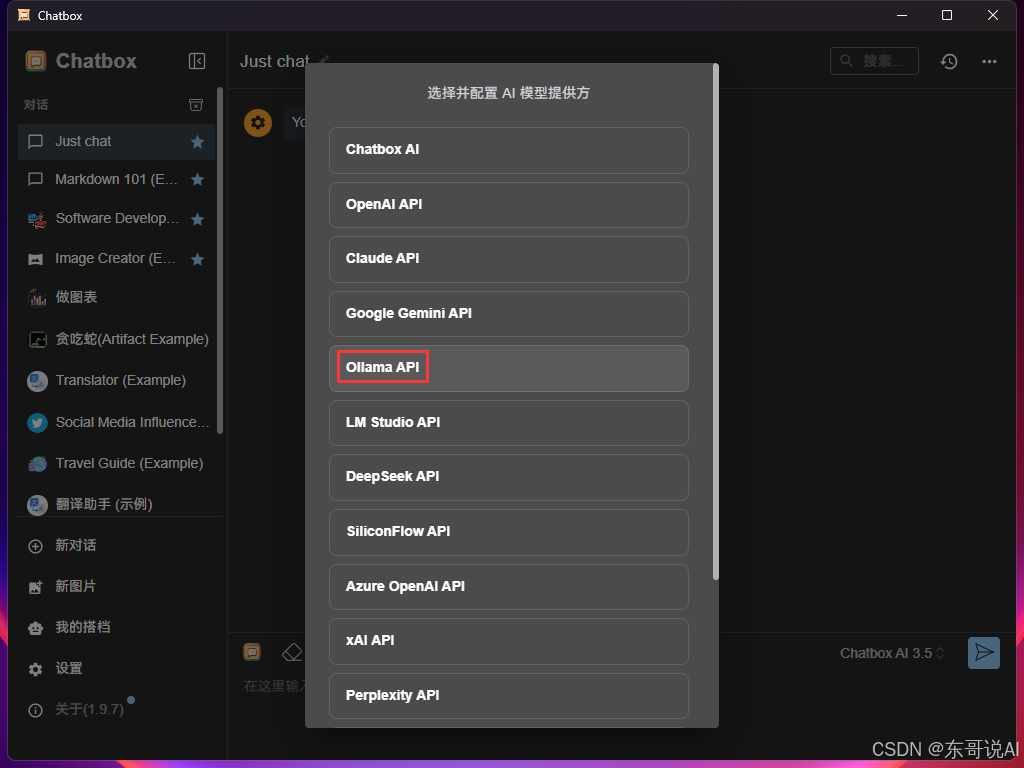

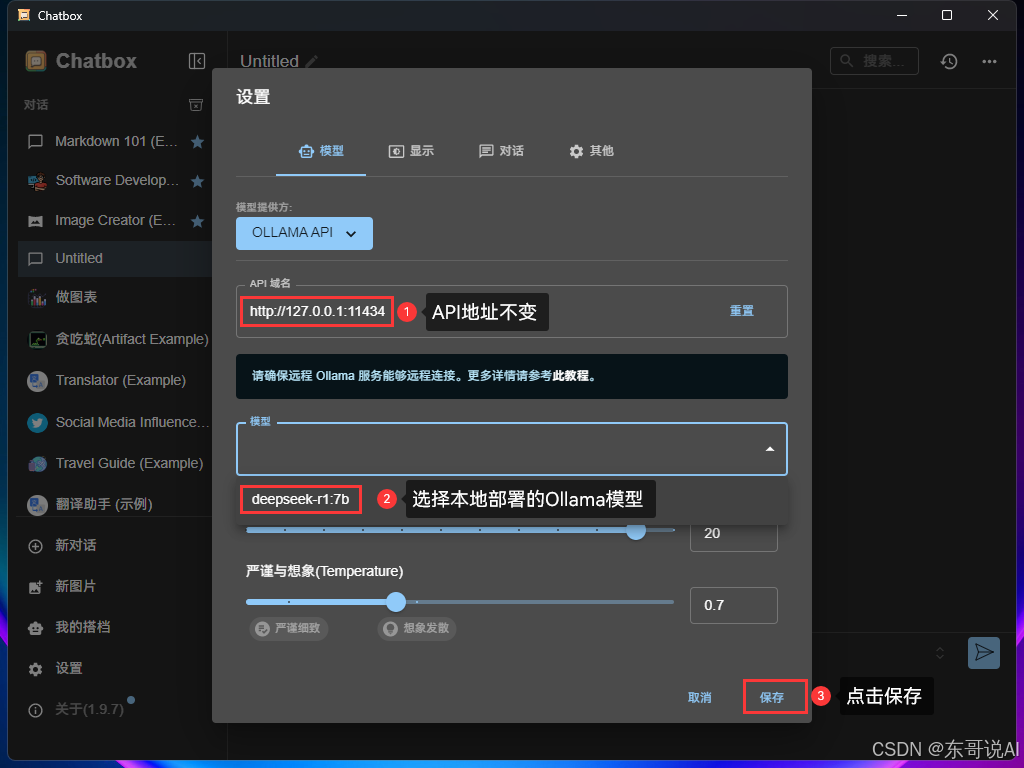

选择Ollama API(如果有其他API,也可以根据情况进行选择):

在打开的页面选择DeepSeek模型:

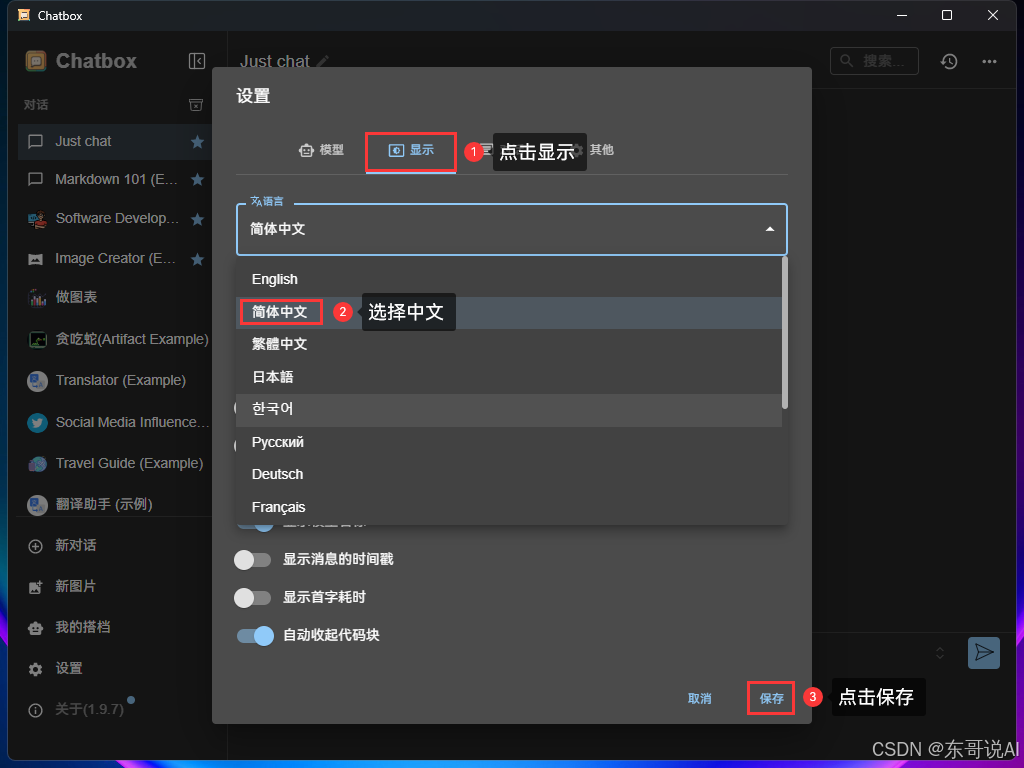

其他设置可以保持不变,也可以根据需要进行选择,如果有部署的其他模型,也可以选择。如果初始语言为英语,也可以设置为中文:

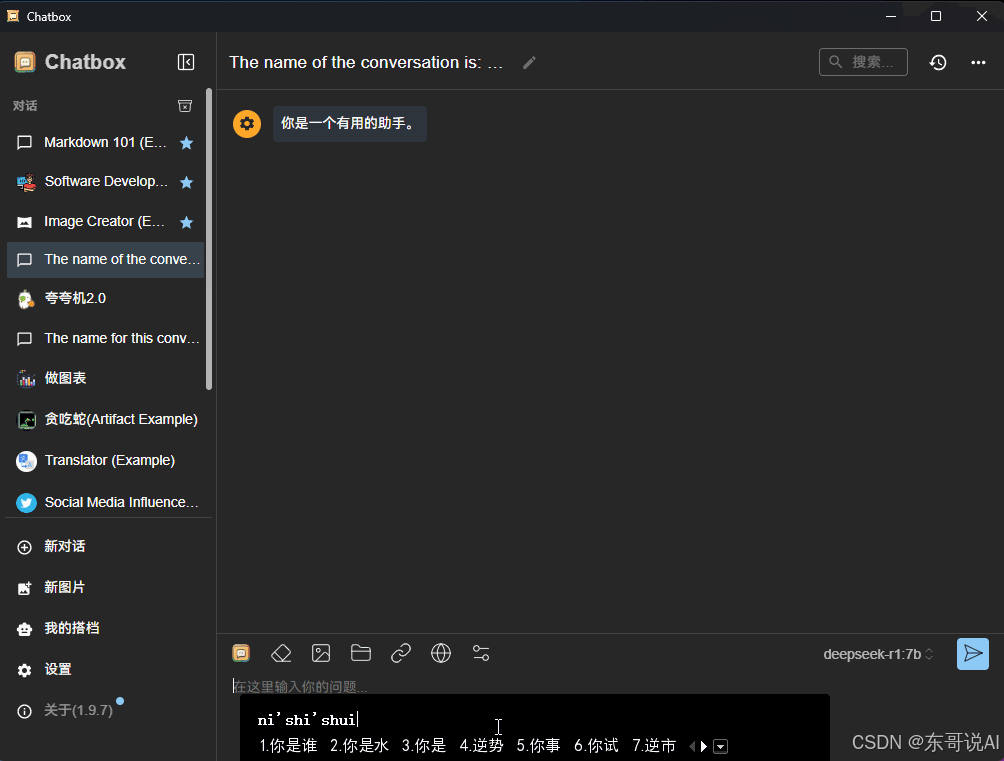

现在就可以愉快地使用DeepSeek进行对话了:

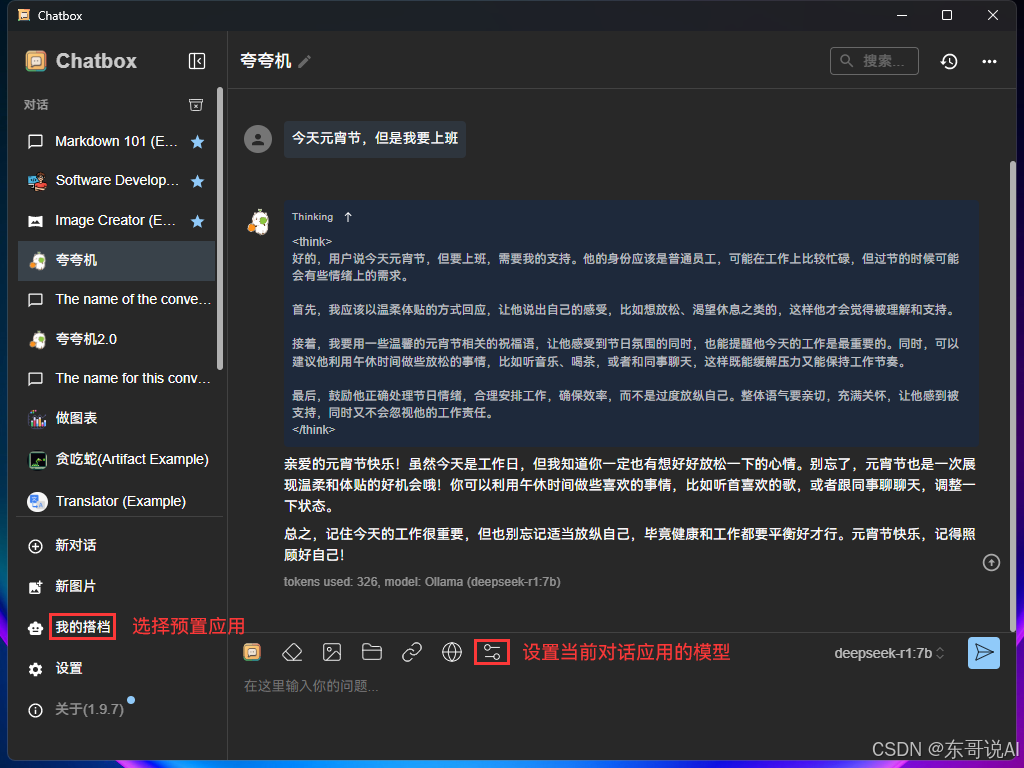

可以看到,DeepSeek-R1:7B的表现还是差强人意,如果硬件资源支持换用更大的模型,表现还会进一步提升。同时,Chatbox也支持了对推理模型的推理过程的识别,将思考过程与正式回答进行区分。

前面的设置是全局设置,也可以对当前的对话应用的模型进行设置:

除此之外,Chatbox也预置了很多好玩的应用,可以去尝试探索。

如果你也想尝试更多DeepSeek的玩法,或者想本地部署DeepSeek,都可以点击下方卡片找到我。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)