大模型应用开发平台Dify搭建!

官网的模型页面:https://ollama.com/library,挑选一下模型。模型的地址:https://ollama.com/library/llama3.1。如果你还没下载过这个模型它就会自动下载,如果已经下载过它就会运行这个模型。官方文档:https://docs.dify.ai/zh-hans。选好版本后,复制上图右侧红框的命令,到你电脑的终端中运行。官网地址:https://oll

Dify 是开源的 LLM 应用开发平台。

❝提供从

Agent构建到AI WorkFlow编排、RAG检索、模型管理等能力,轻松构建和运营生成式AI原生应用。

比

LangChain更易用。

官网:https://difyai.com/

搭建过程

官方文档:https://docs.dify.ai/zh-hans

具体包括以下几步:

❝

安装

Ollama下载大模型

安装

Docker克隆

Dify源代码至本地启动

Dify

安装Ollama

Ollama 是运行大语言模型的环境。

Ollama 官网地址:https://ollama.com/。

进入官网,点击 Download 按钮下载 Ollama 客户端。

下载大模型

到 Ollama 官网的模型页面:https://ollama.com/library,挑选一下模型。

❝包括有很多开源模型,比如阿里的千问2,搜索

qwen2就能找到它。

这里使用 Llama 3.1 。

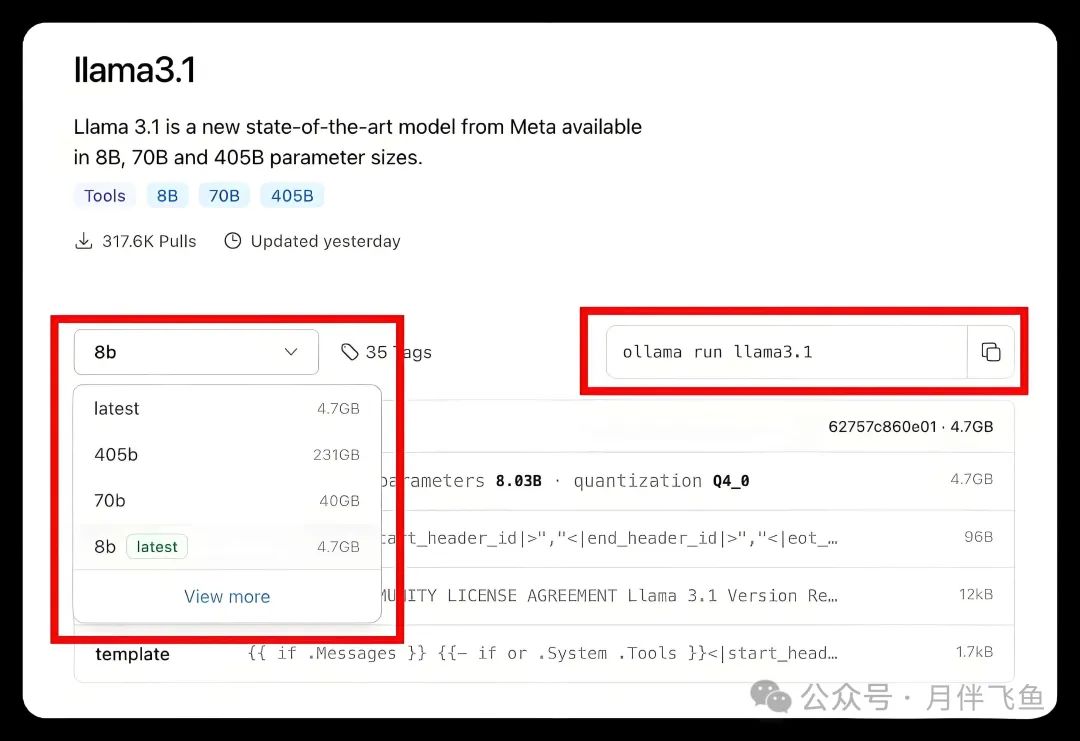

打开Llama 3.1 模型的地址:https://ollama.com/library/llama3.1。

-

根据你需求选择合适的版本,这里选的是

8b版。

选好版本后,复制上图右侧红框的命令,到你电脑的终端中运行。

❝如果你还没下载过这个模型它就会自动下载,如果已经下载过它就会运行这个模型。

运行后,就可以在终端和大模型对话了。

克隆Dify源代码至本地

git clone https://github.com/langgenius/dify.git

启动Dify

进入 Dify 源代码的 Docker 目录,执行一键启动命令:

cd dify/docker

cp .env.example .env

docker compose up -d

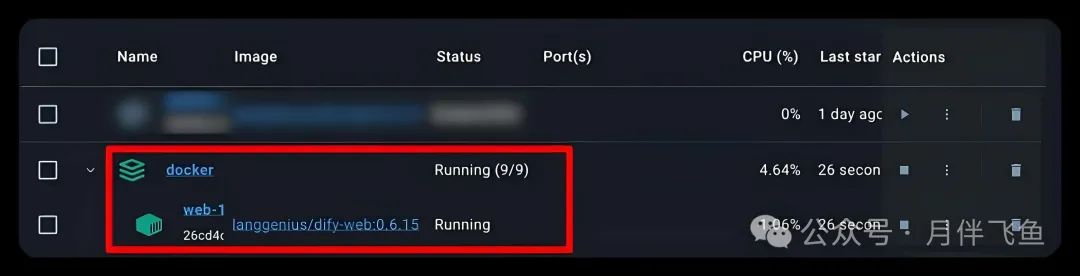

启动完成后,你的 Docker 里就会看到这个:

然后在浏览器输入 http://localhost 。

❝首次打开

Dify需要设置一下管理员的账号。

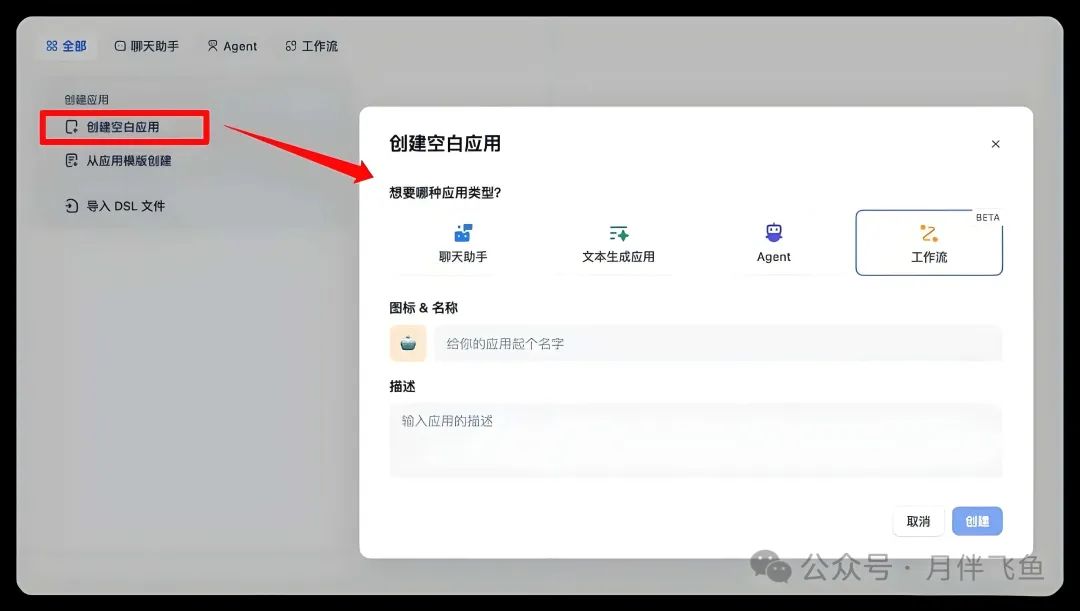

点击 创建空白应用 就可以创建聊天助手、文本生成应用、Agent、工作流。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)