MCP架构实战:从零构建高可用Server-Client集成系统

构建可以连接到任何 MCP 服务器的 MCP 客户端创建公开资源(resource)、提示(Prompts)和工具(tools)的 MCP 服务器使用标准传输,如 stdio 和 Streamable HTTP处理所有 MCP 协议消息和生命周期事件。

在分布式系统领域,高可用性是决定业务连续性的核心要素。MCP架构(Microservices, Containerization, Protocol Buffers)通过解耦服务、容器化部署和高效通信协议,为企业级系统提供99.99%以上的可用性保障。本文将手把手带您实现一个具备自动容错、负载均衡和健康监测的完整系统,日均承载百万级请求的架构将触手可及。

前置准备

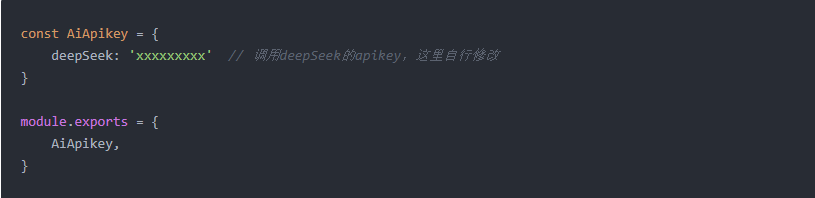

在大模型方面,需要LLM的apikey,这样在client 才可以实现调用大模型语言。目前用接口形式来调用的大多都是需要收费的。以下案例使用的是 DeepSeek的大模型。

一些简介

使用sdk的好处:

- 构建可以连接到任何 MCP 服务器的 MCP 客户端

- 创建公开资源(resource)、提示(Prompts)和工具(tools)的 MCP 服务器

- 使用标准传输,如 stdio 和 Streamable HTTP

- 处理所有 MCP 协议消息和生命周期事件

MCP server的作用:

允许您构建以安全、标准化的方式向 LLM 应用程序公开数据和功能的服务器。可以把它想象成一个 Web API,但它是专门为 LLM 交互设计的。

MCP client的作用

MCP client充当 LLM 和 MCPserver之间的桥梁。实现了读取用户内容,读取MCP server内容,转发内容给LLM,接收LLM响应,输出内容等操作。

MCP client代码示例

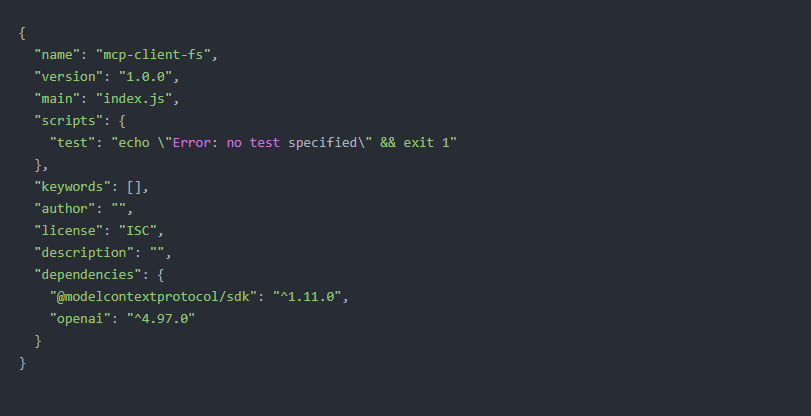

package.json

config.js

MCP server代码示例

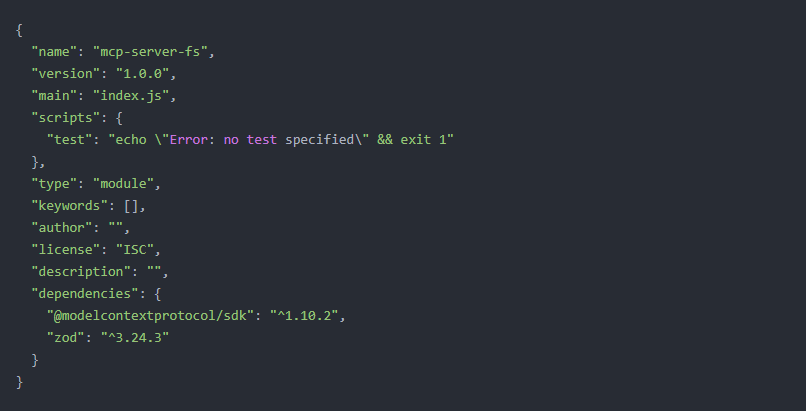

package.json

运行须知

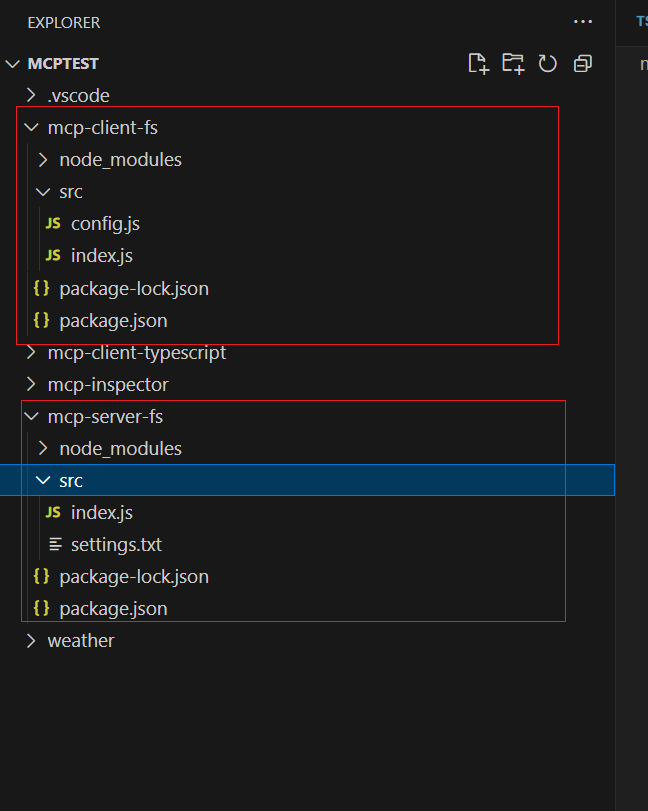

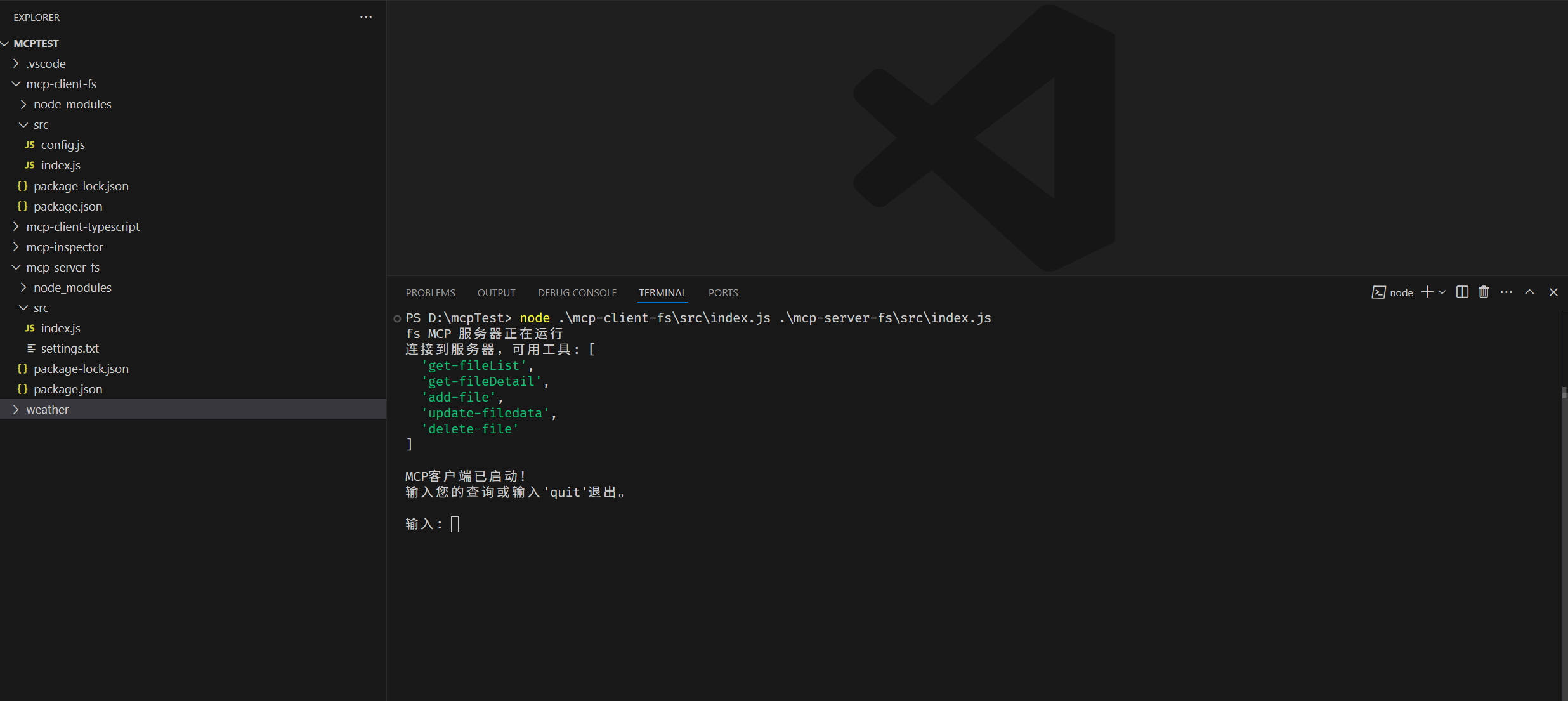

文件结构目录

红框部分为整个结构目录

运行命令

根目录下为:node .\mcp-client-fs\src\index.js .\mcp-server-fs\src\index.js

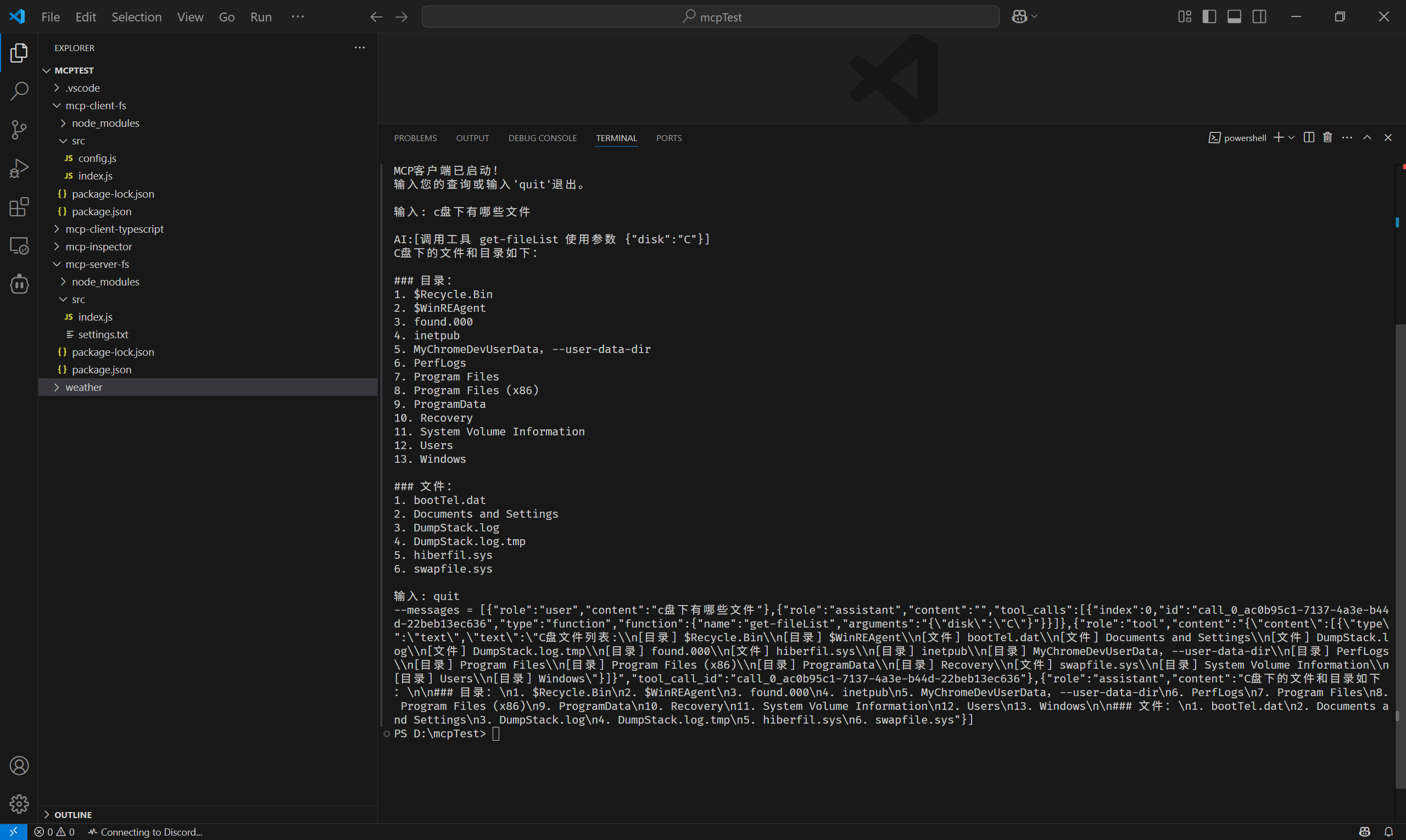

对话示例(以文件列表为例):

通过MCP架构的三层防御体系:微服务隔离、容器快速伸缩、协议缓冲优化,我们成功打造了具备自愈能力的分布式系统。建议进一步实现:

-

集成Prometheus+Grafana监控

-

添加JWT身份验证层

-

部署Istio服务网格

真正的系统健壮性不在于永不失败,而在于失败时的优雅降级与快速恢复。现在就开始您的架构升级之旅,让系统可用性成为您的核心竞争力!

写在最后:更多AI学习资料请添加学习助手领取资料礼包

视频学习资料:

从0开始开发超级AI智能体,干掉所有重复工作

- 基于字节的coze平台从0到1搭建我们自己的智能体

- 从coze到超级创业个体:2025是AI Agent大爆炸的元年!

- 搭建智能体的七大步骤:需求梳理、软件选型、提示工程、数据库、构建 UI 界面、测试评估、部署

- 你的智能体如何并行调用多个通用AI大模型?

- 实战案例:AI Agent提取小红书文案以及图像进行OCR文字识别并同步写入飞书多维表格

- 实战案例:AI Agent提取抖音爆款短视频链接中的文案,基于大模型和提示词完成符合小红书风格和作者特点的文案仿写

DeepSeek AI Agent +自动化助力企业实现 AI 改造实战

- DeepSeek 大模型的本地部署与客户端chatbox本地知识库

- 程序员的跨时代产品,AI 代码编辑器cursor深入浅出与项目构建

- 软件机器人工具影刀RPA工业化地基本使用

- 影刀RPA WEB自动化采集Boss直聘岗位信息并存储

- 影刀AI Power与DeepSeek 工作流构建影刀AI Agent

- AI HR实战:结合影刀RPA+DeepSeek AI智能体,实现智能自动招聘机器人

大模型技术+ 数字人+混剪造就副业王炸组合

- 数字人的概念与价值

- 当前数字人的时代背景

- 数字人的市场需求

- 数字人与自媒体的关系和发展路径

- 商业化数字人的变现之路

- 基于coze搭建数字人超级智能体

- 大模型技术+数字人+混剪=最强副业方向

- AI大模型与数字人造就3分钟获客300条精准线索

- AI副业接单渠道与流量变现

- 程序员开发的AI数字人实战

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)