一文看懂 MCP 大模型架构:从事件驱动到智能涌现,全链路实战解构!

从(Know-What)到(Know-How): 1、认知迭代:认知智能体在流程自动化、决策辅助等领域的颠覆性 2、场景淬炼:通过“需求探矿-场景验证-价值量化”三阶模型 3、工程落地:构建Agent的完整技术栈企业要真正跑通“大模型”,不是单靠一个 LLM 就能搞定的,而是需要一整套“连接上下游、支撑大规模、多轮优化”的系统工程。今天这篇文章,我们就来深度解析MCP大模型架构的全景图,从技术底座

前言

从(Know-What)到(Know-How): 1、认知迭代:认知智能体在流程自动化、决策辅助等领域的颠覆性 2、场景淬炼:通过“需求探矿-场景验证-价值量化”三阶模型 3、工程落地:构建Agent的完整技术栈

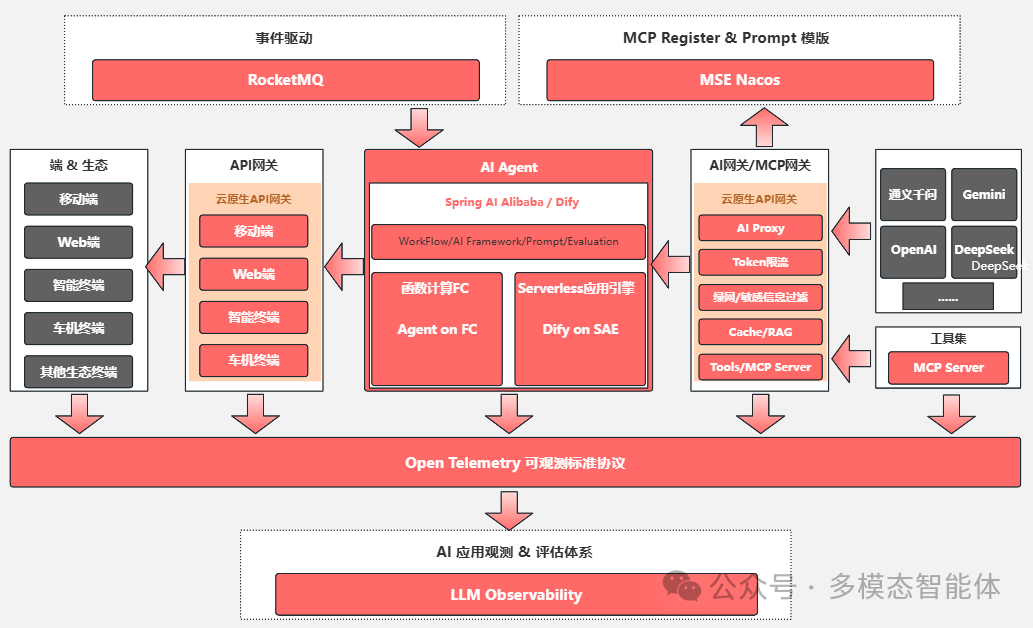

企业要真正跑通“大模型”,不是单靠一个 LLM 就能搞定的,而是需要一整套“连接上下游、支撑大规模、多轮优化”的系统工程。今天这篇文章,我们就来深度解析MCP大模型架构的全景图,从技术底座到交互体验,带你一次性看懂企业级 AI 是怎么“跑起来”的!

一、事件驱动是灵魂——RocketMQ 撬动 AI 的第一颗齿轮

如果把大模型看作一个复杂的工业引擎,那事件驱动就是它的点火系统。MCP 架构首要解决的问题,不是大模型本身,而是如何让“人”和“模型”的交互变得更稳定、更高效、更具弹性。MCP 使用了 RocketMQ 来作为全局事件总线。你可以把它想象成 AI 大脑的“神经网络”:

- 用户在 App 上发起一个请求,它会被封装成事件;

- 这个事件被投递到 RocketMQ 消息队列;

- 下游的 AI Agent、工具链路、日志系统等模块分别订阅这个事件,各自“领任务”。

为什么不用传统调用?

传统接口调用是同步阻塞的——“我说完话,你得立刻回答”。但大模型的响应,不一定一瞬间就出结果(比如涉及 RAG、函数调用、插件、长链路流程等)。RocketMQ 让请求流程变成可异步、可重试、可追踪的流程,极大地释放了系统弹性。

小结: 事件驱动不是为了炫技,而是为了解决真实场景中的“突发、高并发、长流程”的痛点,是让后续架构都能“松耦合、高可用”的前提。

二、Prompt 模版 + 服务注册——统一中台的大脑中枢

有了事件,还需要“规则”和“配置”来调度这个大脑。MCP 架构里,这一层使用了阿里的 MSE Nacos,充当“中控大脑”:

- 服务注册发现:所有 AI Agent、工具插件、模型服务等都在这里注册,谁在线谁不在线,系统一目了然;

- Prompt 模版管理:不同的业务场景(客服问答、智能推荐、报告生成)使用不同的 Prompt,这些都集中配置在 Nacos,随时热更新;

- 权限与限流:哪个服务可用、限速、灰度发布,都通过中心统一控制。

想象你在驾驶一台超级汽车,RocketMQ 是油门,Nacos 就是仪表盘+方向盘——控制整个架构的方向、速度和安全性。更重要的是:当 MCP 要对接多个模型服务(阿里通义、OpenAI、Gemini、百度、DeepSeek 等),Nacos 就成了标准化协议的粘合剂,大大减少集成和运维成本。

三、多端接入统一入口——AI 的边界被打通

在传统系统中,移动端、Web、车机、IoT 等各自为战、接口杂乱、协议不统一。但在 MCP 架构中,“统一接入”是第一原则。MCP 构建了一个统一的接入层,对接包括:

- 移动端:App、小程序,轻量快速

- Web 端:管理系统、前台 H5,支持图文富交互

- 车机终端:更偏自然语言、语音对话

- IoT 智能设备:语音唤醒 + 云端推理

- 第三方生态:如钉钉、企业微信、SaaS 平台

无论从哪里来,统一从 MCP 的 API 网关入口进来。这让整个大模型架构具备“任意端都能触达 AI 服务”的跨平台能力。在 AI 时代,用户入口碎片化已成常态。MCP 所做的就是构建一条“任意终端都能触达智能能力”的高速公路。

四、API 网关——构建安全、弹性、灰度的总控制器

当所有终端都打通之后,问题来了:

- 如何统一限流?

- 如何灰度发布一个新的大模型?

- 如何保障恶意调用不拖垮整个系统?

MCP 的答案是:构建强大的 API 网关层。在这层,系统会做很多看不见却非常关键的事情:

- 鉴权验证:防止未授权的调用

- 流量控制:避免高并发打爆后端大模型服务

- 协议转换:支持 REST、gRPC、WebSocket 等不同协议的平滑兼容

- 灰度发布:支持按地域、账号、用户等级动态灰度大模型版本(例如 A/B 测试新的 Prompt)

为什么这一步重要?

因为一旦接入多模型、多 Agent、多业务场景,不加治理就会变成“灾难现场”。API 网关相当于 MCP 的“守门人”,它不做智能,但它决定谁能进入智能的大门。

五、AI Agent 核心引擎——大模型的“执行官”

终于到了主角——AI Agent 引擎。这部分,是整个 MCP 的“智能大脑”。它的职责非常关键:把一个用户请求,转化为结构化的 Prompt,送给模型,然后根据结果做处理、判断、函数调用、链路编排等。AI Agent 并不只是“调模型”,它做的远比这多:

- Prompt 构造 + 模板匹配

- 上下文记忆管理

- 是否需要工具调用 / 插件扩展

- 是否需要分步骤链路(WorkFlow)执行

- 是否返回结果还是继续任务流转

在 MCP 架构中,Agent 引擎有两种运行方式:

- 函数计算 FC 模式(Agent on FC):轻量、快启、成本低,适合短链路(如普通问答)

- Serverless 应用引擎(Dify on SAE):适合长链路(RAG、多轮对话、Agent 编排)

这就像是一个“智能指挥官”,不仅懂 Prompt,还能调兵遣将,整合企业内外部知识和工具链。

六、AI 网关 / MCP 网关——生成式 AI 的安全护栏

普通网关只能控制请求,但生成式 AI 的难点是“结果不可控”。所以 MCP 架构设计了专门的 AI 网关,它不仅是通道,还是一道“智能防火墙”:

- Token 限流:避免成本爆炸,控制单次调用的 token 上限

- 内容脱敏 + 审查:拦截暴露公司信息、个人数据、敏感内容

- RAG 接入缓存:复用知识检索结果,提高响应速度

- 插件工具调度:如果用户提问需要查系统库存、调用天气接口,这一层就帮 Agent 发起请求

简而言之,AI 网关是生成式 AI 的“保险丝”——它知道哪句话不能说、哪个插件不能乱调,是 AI 上岗之前的“安全审核官”。

七、工具集 & LLM 服务——模型只是一个零件

MCP 并不依赖某一个大模型,而是通过 AI Proxy + Tools Server 将所有模型和工具“模块化”:

- 主流 LLM 支持:通义千问、OpenAI、Gemini、百度、智谱、DeepSeek 全接入

- 企业内工具集成:库存系统、客户系统、知识库、审批流、文档检索系统

MCP 的理念是:“模型是流水线的一个节点,而不是全部”。企业真正的能力,往往在自己的系统、数据、工具中,Agent 只是让它们更聪明。

八、全链路可观测性——大模型不再是“黑盒”

如果没有“监控”,就没有“持续优化”。MCP 使用 OpenTelemetry + 自研链路跟踪系统,实现了:

- 从用户请求 → API 网关 → AI Agent → 工具调用 → 模型服务 的全链路埋点;

- 实时采集 QPS、响应时长、Token 使用量、错误率;

- 自动化告警+熔断机制,确保系统鲁棒性;

- 更进一步:结合 Prompt 输出质量评估、业务转化率,闭环优化。

换句话说,MCP 不是做完一个 Agent 就交差,而是把每一个智能交互都“量化”,并推动“持续进化”。

九、评估体系——让大模型为业务“提效”而不是“烧钱”

最终,大模型是否有效,不是看参数,不是看模型论文,而是看它:

- 有没有帮业务减少客服成本?

- 有没有提升用户转化?

- 有没有降低错误率、提升满意度?

MCP 构建了一整套多维评估体系,涵盖:

- 技术维度:Token 成本、调用成功率、响应时长;

- 内容维度:回答是否准确?是否跑题?是否冗长?

- 业务维度:用户是否接受推荐?是否留下线索?是否完成下单?

这才是真正落地的大模型,而不是 PPT 上的“空中楼阁”。

十、总结

MCP 架构的五大价值总结:

- 低耦合、高弹性架构设计,适合快速试错与扩展

- Prompt + Agent + 工具链,实现 AI 生产力组合式落地

- 多模型接入、插件支持、安全网关,让智能更可控

- 全链路可观测,实现 AIGC 过程与结果的量化评估

- 安全合规、稳定高效,真正支撑“上生产”的 AI 应用

如果你正在:

- 构建企业级智能助手

- 搭建多模型服务统一接入平台

- 推动 AI 和业务深度融合

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献50条内容

已为社区贡献50条内容

所有评论(0)