AI大模型学习路线:从入门到精通的完整指南【2025最新】

我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。作为普通人,入局大模型时代需要持续学习和实践,不断提高

引言

近年来,以GPT、BERT、LLaMA等为代表的AI大模型彻底改变了人工智能领域的技术格局。它们不仅在自然语言处理(NLP)任务中表现卓越,还在计算机视觉、多模态交互等领域展现出巨大潜力。本文旨在为开发者、研究者和技术爱好者提供一条清晰的学习路径,帮助读者逐步掌握大模型的核心技术并实现实际应用。

一、基础阶段:构建知识体系

- 数学与理论基础

线性代数:矩阵运算、特征值与奇异值分解是大模型参数优化的基础。

概率论与统计:理解贝叶斯理论、最大似然估计及概率分布模型。

微积分:梯度下降、反向传播等优化算法依赖导数与偏导数知识。

信息论:交叉熵、KL散度是衡量模型输出与真实分布差异的核心指标。

推荐资源:

《Deep Learning》第2章(数学基础)、3Blue1Brown的线性代数系列视频。

- 编程与工具掌握

Python:掌握NumPy、Pandas等数据处理库,熟悉面向对象编程。

深度学习框架:

PyTorch:动态计算图和灵活调试特性适合研究场景。

TensorFlow:静态图优化适用于工业级部署。

分布式训练工具:了解Horovod、DeepSpeed的分布式并行机制。

实践建议:

通过Kaggle竞赛或Hugging Face的Transformer实战项目巩固技能。

- 机器学习基础

监督学习:掌握逻辑回归、支持向量机等经典算法。

无监督学习:理解聚类(K-Means)与降维(PCA)方法。

深度学习基础:

全连接网络与反向传播原理

CNN在图像处理中的应用

RNN/LSTM处理序列数据的机制

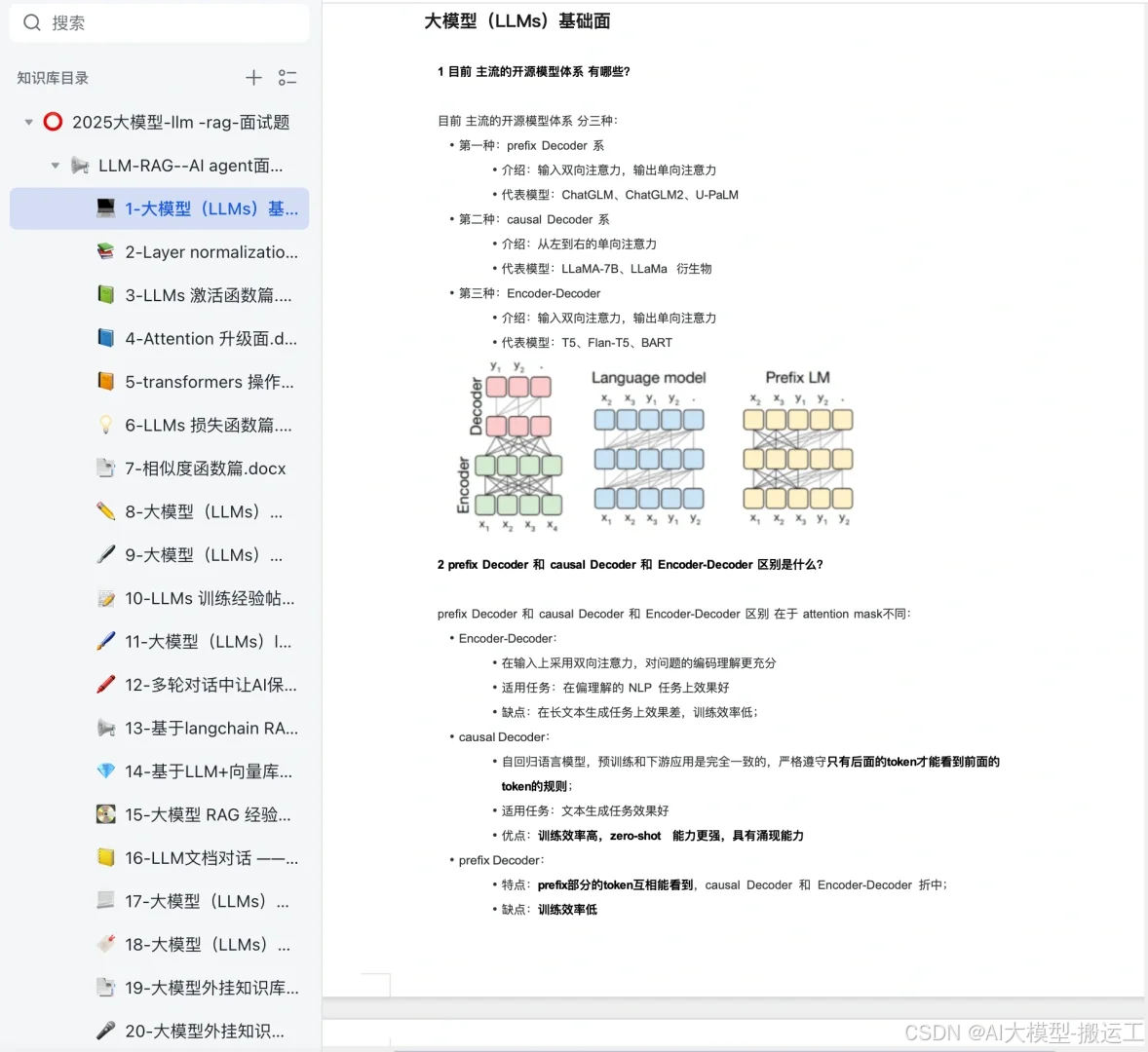

二、核心进阶:深入大模型技术

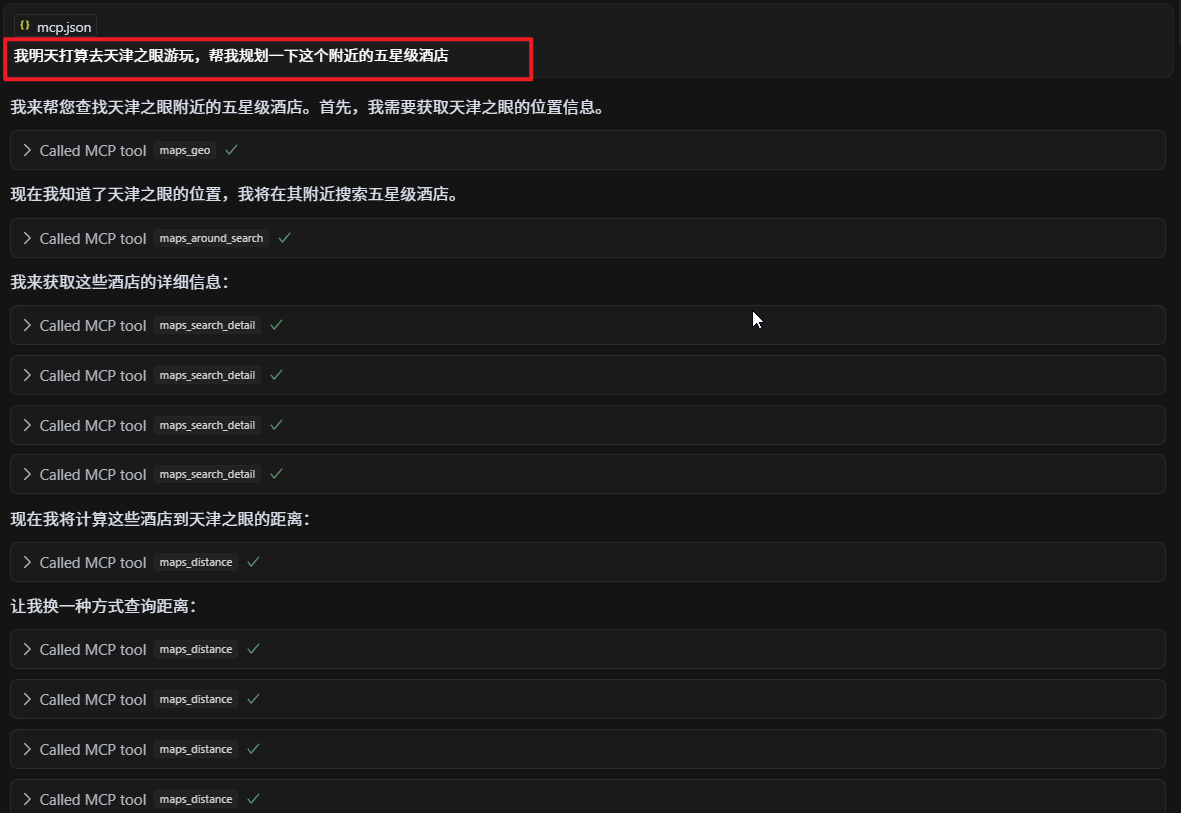

- Transformer架构精解

自注意力机制:Query-Key-Value矩阵计算与多头注意力实现。

位置编码:绝对位置编码(Sinusoidal)与相对位置编码(RoPE)对比。

编码器-解码器结构:BERT(仅编码器)与GPT(仅解码器)的架构差异。

关键论文:

《Attention Is All You Need》(2017)是必读经典。

- 预训练与微调技术

预训练任务设计:

MLM(掩码语言模型)用于BERT

Next Token Prediction驱动GPT生成能力

微调策略:

全参数微调 vs. 参数高效微调(PEFT)

LoRA(低秩适配)与Adapter的实际应用

提示工程:Few-shot Learning与Chain-of-Thought提示设计技巧。

- 大模型关键技术

模型缩放定律:理解计算量、数据量与模型性能的关系(Chinchilla法则)。

高效训练技术:

混合精度训练(FP16/FP32)

ZeRO优化器减少显存占用

梯度检查点技术

推理加速:量化(INT8)、模型剪枝与知识蒸馏实践。

三、实践阶段:从理论到应用

- 模型训练全流程

数据准备:

使用WebText、The Pile等开源数据集

数据清洗与Tokenizer选择(如BBPE、WordPiece)

框架选择:

Hugging Face Transformers快速实现模型

Megatron-LM支持千亿级参数训练

训练优化:

学习率调度(Warmup、Cosine衰减)

损失函数选择(交叉熵、对比学习损失)

案例参考:

使用Colab免费GPU微调BERT完成文本分类任务。

- 行业落地挑战

领域适配:医疗、金融等垂直领域的数据标注与知识注入方法。

模型压缩:

权重共享(ALBERT)

结构化剪枝与量化感知训练

部署实践:

ONNX格式转换

Triton Inference Server高性能部署

四、前沿探索:技术趋势与研究方向

- 多模态大模型

视觉-语言模型:CLIP的图文对齐机制、BLIP-2的多模态训练策略。

3D与视频理解:PointCloud Transformer处理三维数据。

- 强化学习与对齐

RLHF(人类反馈强化学习):ChatGPT对齐人类价值观的核心技术。

可解释性研究:注意力可视化与概念神经元分析。

- 新型架构探索

稀疏专家模型:Switch Transformer的MoE架构设计。

Retentive Network:替代Transformer的长序列处理方案。

五、学习资源推荐

- 书籍与课程

书籍:《自然语言处理实战:应用Transformer模型》(Manning Publications)

在线课程:

Andrew Ng《Deep Learning Specialization》

Stanford CS224N(NLP与深度学习)

- 开源项目

模型库:Hugging Face Model Hub、Meta的LLaMA系列

训练框架:DeepSpeed、Colossal-AI

- 社区与论坛

学术平台:arXiv(关注cs.CL、cs.LG板块)

开发者社区:GitHub大模型专题、Hugging Face论坛

六、学习建议

系统化学习:按照"理论→代码→论文复现"的顺序逐步深入。

动手实践:至少完成一个从数据准备到模型部署的全流程项目。

跟踪前沿:定期阅读ICLR、NeurIPS等顶会论文。

社区参与:通过Kaggle竞赛或开源项目积累实战经验。

结语

AI大模型的学习既需要扎实的理论基础,也离不开持续的工程实践。随着技术迭代加速,保持开放心态和持续学习能力将成为开发者的核心竞争力。希望本文能为您的学习之旅提供清晰的导航。

如何学习AI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)