元学习简单介绍

元学习在元学习过程中,模型在元训练集中学习不同的任务。在该过程中存在两种优化:学习新任务的学习者(器)和训练学习者的元学习者。元学习方法通常属于下面三个范畴中的一个:循环模型(recurrent model)、度量学习(metric learning)和学习优化器(learning optimizer)(三种元学习方法)。循环模型这种元学习方法训练一个循环模型(即LSTM),模型从数据集中获取序列

https://blog.csdn.net/c9Yv2cf9I06K2A9E/article/details/88968474

元学习

在元学习过程中,模型在元训练集中学习不同的任务。在该过程中存在两种优化:学习新任务的学习者(器)和训练学习者的元学习者。元学习方法通常属于下面三个范畴中的一个:循环模型(recurrent model)、度量学习(metric learning)和学习优化器(learning optimizer)(三种元学习方法)。

循环模型

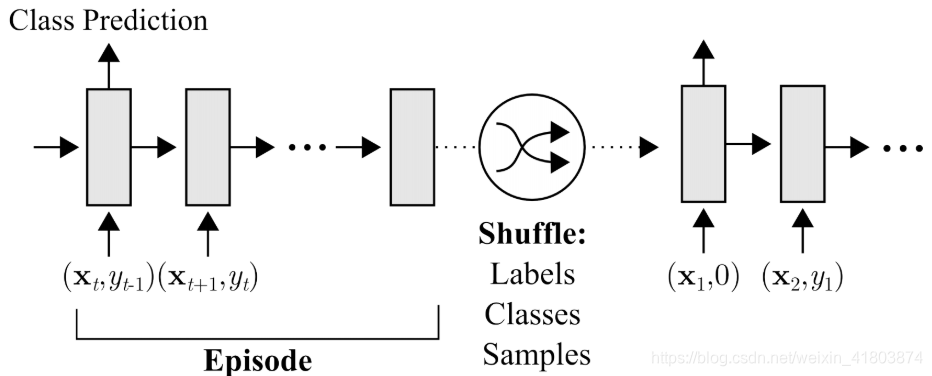

这种元学习方法训练一个循环模型(即 LSTM),模型从数据集中获取序列输入,然后处理任务中新的输入。在图像分类设置中,这可能包括从(图像、标签)对数据集中获取序列输入,再处理必须分类的新样本。

输入 xt 和对应标签 yt 的循环模型(一个Epiode包含训练和测试,参考LSTM_Optimization as a model for few-shot learning对数据集的解释)

元学习者使用梯度下降(Adam ),而学习者仅运行循环网络。该方法是最通用的方法之一,且已经用于小样本的分类、回归任务,以及元强化学习中。尽管该方法比较灵活,但由于学习者网络需要从头设计学习策略,因此该方法比其他元学习方法的效率略低。

度量学习

即学习一个度量空间,在该空间中的学习异常高效,这种方法多用于小样本分类。直观来看,如果我们的目标是从少量样本图像中学习,那么一个简单的方法就是对比你想进行分类的图像和已有的样本图像。但是,正如你可能想到的那样,在像素空间里进行图像对比的效果并不好。不过,你可以训练一个 Siamese 网络或在学习的度量空间里进行图像对比。与前一个方法类似,元学习通过梯度下降(或者其他神经网络优化器)来进行,而学习者对应对比机制,即在元学习度量空间里对比最近邻。这些方法用于小样本分类时效果很好,不过度量学习方法的效果尚未在回归或强化学习等其他元学习领域中验证。

学习优化器

(感觉跟循环模型相似?在论文中:Learning to learn by gradient descent by gradient descent)

最后一个方法是学习一个优化器,即一个网络(元学习者)学习如何更新另一个网络(学习者),以使学习者能高效地学习该任务。该方法得到广泛研究,以获得更好的神经网络优化效果。元学习者通常是一个循环网络,该网络可以记住它之前更新学习者模型的方式。我们可以使用强化学习或监督学习对元学习者进行训练。近期,Ravi 和 Larochelle 证明了该方法在小样本图像分类方面的优势,并表示学习者模型是一个可学习的优化过程。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)